大模型多 LoRA 部署:极致显存优化方案

背景与问题

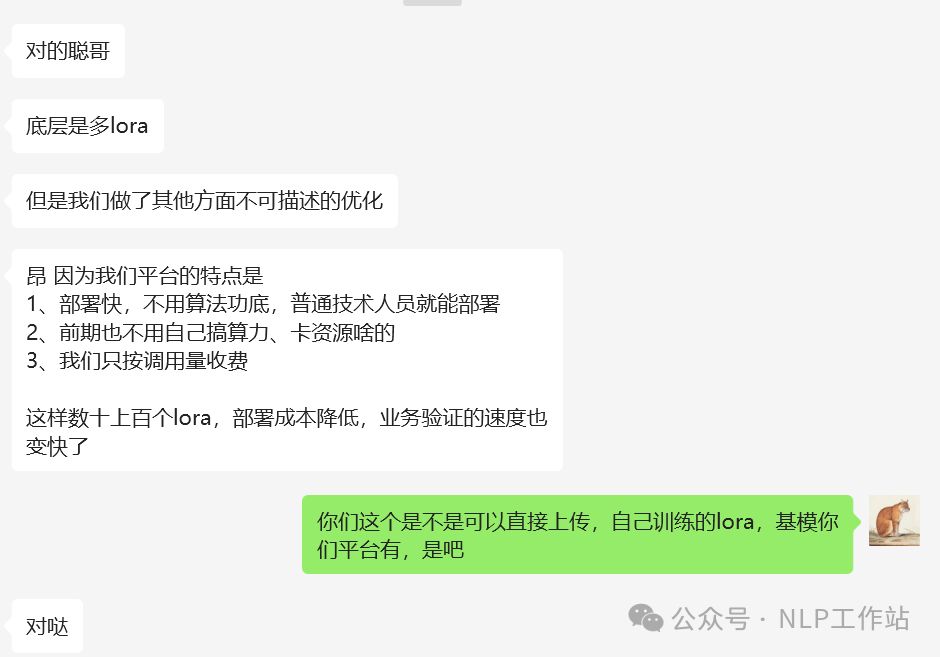

在人工智能应用开发中,经常面临需要同时支持多个垂直领域任务的情况。例如,一个客服系统可能需要同时处理售前咨询、售后技术支持和订单查询等不同场景。针对这些场景,通常的做法是为每个任务训练独立的 LoRA(Low-Rank Adaptation)微调模型。

然而,如果将每个 LoRA 模型都 Merge(合并)回基座模型并单独部署,会导致资源浪费。假设有一个 7B 参数的基座模型,部署一份需要占用约 14GB 显存(FP16)。如果有 10 个不同的 LoRA 任务,分别部署意味着需要 10 份基座权重,总计消耗 140GB 显存,这对大多数单卡或双卡环境来说是不可接受的。

此外,模型文件的复制、上传以及加载时间也会随着部署数量的增加而线性增长,影响业务上线效率。

解决方案:多 LoRA 动态加载

为了解决上述问题,vLLM 等推理框架支持在同一基座模型上动态加载多个 LoRA 适配器。其核心原理是:

- 共享基座权重:基座模型的参数只加载一次到显存中,所有 LoRA 任务共享这部分内存。

- 独立 LoRA 权重:LoRA 适配器仅包含低秩矩阵,参数量极小(通常仅为基座的 1% 左右),可以灵活切换。

- 运行时计算:在推理时,根据请求指定的 LoRA ID,将对应的 LoRA 权重叠加到基座权重的梯度更新路径上。

这种方案的显存占用约为:显存 = 基座模型显存 + (N * LoRA 模型显容)。相比全量部署,显存节省效果显著,但代价是每次推理都需要进行额外的矩阵乘法运算,因此推理速度会比 Merge 后的模型稍慢。

技术实现细节

1. 环境准备

确保安装了支持 LoRA 的 vLLM 版本以及相应的依赖库。

pip install vllm transformers accelerate

2. 代码示例

以下代码展示了如何使用 vLLM 加载基座模型并动态调用两个不同的 LoRA 适配器。

from vllm import LLM, SamplingParams

from vllm.lora.request import LoRARequest

from transformers import AutoTokenizer

# 定义提示词

prompts = ["你是谁?", "你由谁训练?"]

# 设置生成参数

sampling_params = SamplingParams(

temperature=0.7,

top_p=0.8,

top_k=50,

max_tokens=2048

)

# 定义 LoRA 请求对象

# lora_name: 适配器名称标识

# lora_int_id: 整数 ID,用于内部索引

# lora_local_path: 本地 LoRA 权重路径

lora_request_1 = LoRARequest("adapter_v1", 1, lora_local_path="output_dir_qwen2.5_lora_v1/")

lora_request_2 = LoRARequest(, , lora_local_path=)

llm = LLM(

model=,

enable_lora=,

max_model_len=,

dtype=

)

tokenizer = AutoTokenizer.from_pretrained()

temp_prompts = [

tokenizer.apply_chat_template(

[{: , : prompt}],

tokenize=

) prompt prompts

]

prompt_token_ids = tokenizer(temp_prompts).input_ids

()

outputs = llm.generate(

sampling_params=sampling_params,

prompt_token_ids=prompt_token_ids,

lora_request=lora_request_1

)

i, output (outputs):

()

()

outputs = llm.generate(

sampling_params=sampling_params,

prompt_token_ids=prompt_token_ids,

lora_request=lora_request_2

)

i, output (outputs):

()

()

outputs = llm.generate(

sampling_params=sampling_params,

prompt_token_ids=prompt_token_ids

)

i, output (outputs):

()