AI 提示词工程实战:从模糊指令到精准输出的进阶指南

引言

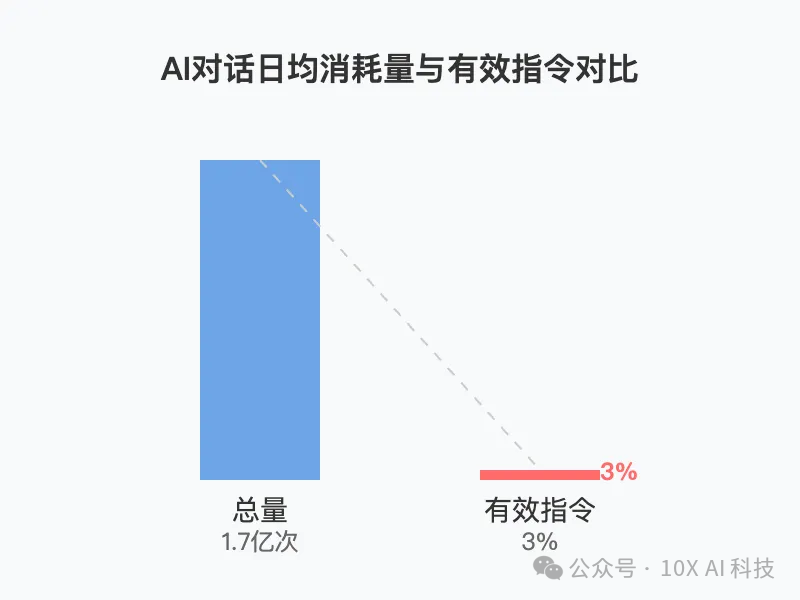

在人工智能技术飞速发展的今天,大语言模型(LLM)已成为提升工作效率的重要工具。然而,许多用户在使用 AI 时仍停留在简单的对话层面,未能充分发挥其潜力。数据显示,大量企业产生的 AI 交互中,有效指令比例不足 3%,大部分效率损耗源于提问方式的不当。

这并非单纯的技术使用差异,而是一场认知能力的竞争。掌握提示词工程(Prompt Engineering),意味着能够更精准地引导模型输出高质量结果,从而在商业决策、内容创作及代码开发中获得显著优势。

一、核心概念:什么是提示词工程?

提示词工程是指通过设计、优化输入给大模型的文本指令,以获取预期输出的过程。它不仅仅是写一句话,而是涉及对模型理解能力、上下文窗口、参数配置的综合运用。

1.1 为什么需要结构化提示词?

大模型基于概率预测下一个 token,缺乏真正的逻辑推理能力。模糊的指令会导致模型产生幻觉或偏离主题。结构化的提示词通过明确角色、任务、约束和格式,降低了不确定性。

对比示例:

- 低效指令:帮我写个营销方案。

- 高效指令:你是一名拥有 10 年经验的数字营销专家。请为一款面向 Z 世代的智能手表撰写一份抖音推广方案。要求包含目标受众分析、核心卖点提炼、三个创意脚本大纲及预算分配建议。输出格式为 Markdown 表格。

1.2 提示词的四大要素

一个高质量的提示词通常包含以下四个维度:

- 角色设定 (Role):定义 AI 的身份,如'资深 Python 工程师'、'医疗领域顾问'。

- 任务描述 (Task):清晰说明需要完成的具体工作。

- 约束条件 (Constraints):限制输出范围、风格、长度或禁止事项。

- 输出格式 (Format):指定结果的呈现方式,如 JSON、Markdown、列表等。

二、进阶技巧:提升输出质量的方法论

2.1 思维链 (Chain of Thought)

对于复杂问题,直接要求答案往往效果不佳。引导模型分步思考可以显著提升准确性。

示例: 不要只问:'这个数学题的答案是多少?' 改为:'请先列出解题步骤,分析已知条件,逐步推导,最后给出结论。'

2.2 少样本学习 (Few-Shot Prompting)

提供几个输入输出的示例,能让模型快速模仿特定模式。

用户:将这句话翻译成英文。

助手:Hello, world!

用户:你好,世界。

助手:Hello, world!

用户:早上好。

助手:Good morning.

2.3 参数调优

在实际 API 调用中,调整模型参数能改变输出特性:

- Temperature:控制随机性。0.0 最确定,1.0 最多样。创意写作可设为 0.7,代码生成建议 0.2。

- Top_P:核采样阈值,限制候选词范围。

- Max Tokens:限制生成长度,防止截断。

三、实战案例:Python 集成与自动化

在实际开发中,我们常需将提示词工程集成到工作流中。以下是一个使用 Python 调用大模型 API 的基础示例,展示了如何动态构建提示词并处理响应。

3.1 环境准备

确保已安装必要的库:

pip install requests python-dotenv

3.2 代码实现

import os

import requests

import json

from dotenv import load_dotenv

load_dotenv()

API_KEY = os.getenv("LLM_API_KEY")

BASE_URL = "https://api.example.com/v1/chat/completions"

def generate_prompt(role, task, constraints):

prompt = f"""

Role: {role}

Task: {task}

Constraints:

- {constraints}

Please output the result directly without extra explanation.

"""

return prompt.strip()

def call_llm(prompt, temperature=0.5):

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

payload = {

"model": "gpt-4o-mini",

"messages": [{"role": "user", "content": prompt}],

"temperature": temperature,

"max_tokens": 2000

}

response = requests.post(BASE_URL, headers=headers, json=payload)

if response.status_code == 200:

data = response.json()

return data["choices"][0]["message"]["content"]

else:

raise Exception(f"API Error: {response.text}")

if __name__ == "__main__":

role = "Senior Data Analyst"

task = "Analyze the sales trend based on the provided data"

constraints = "Use bullet points, highlight key metrics, suggest next steps"

user_input = "Sales increased by 15% in Q3, driven by mobile app usage."

full_prompt = generate_prompt(role, task + "\nData: " + user_input, constraints)

try:

result = call_llm(full_prompt)

print(result)

except Exception as e:

print(f"Error occurred: {e}")

3.3 错误处理与重试机制

生产环境中必须考虑网络波动和 API 限流。建议增加指数退避重试逻辑:

import time

def call_with_retry(prompt, max_retries=3):

for i in range(max_retries):

try:

return call_llm(prompt)

except Exception as e:

if i == max_retries - 1:

raise e

wait_time = 2 ** i

print(f"Retrying in {wait_time} seconds...")

time.sleep(wait_time)

四、常见陷阱与优化策略

4.1 避免过度复杂化

虽然细节很重要,但过长的提示词可能导致模型注意力分散。保持指令简洁明了,关键信息前置。

4.2 防止上下文污染

在多轮对话中,历史消息可能干扰当前任务。定期总结对话摘要,或使用系统级指令重置上下文。

4.3 评估与迭代

建立反馈闭环是持续优化的关键。每次生成后,人工评估结果质量,记录失败案例,更新提示词模板。

评估指标:

- 准确率:是否满足业务需求。

- 一致性:多次运行是否稳定。

- 安全性:是否包含敏感信息或不当内容。

五、未来展望

随着多模态大模型的发展,提示词工程将不再局限于文本。未来的交互将融合图像、音频和视频的理解。开发者需要关注以下趋势:

- 自动提示优化:利用强化学习自动寻找最优提示词组合。

- Agent 协作:多个 AI 代理分工合作完成复杂任务。

- 垂直领域微调:针对特定行业数据训练专用模型,减少通用提示词的依赖。

结语

提示词工程不仅是技术技能,更是新时代的核心竞争力。通过掌握结构化设计、参数调优及自动化集成方法,你可以将 AI 从简单的聊天工具转变为强大的生产力引擎。从现在开始,重新审视你的每一次提问,用更精准的指令换取更卓越的结果。

本文旨在分享通用的提示词工程方法论与代码实践,不涉及任何特定平台的推广或引流信息。