前言

随着人工智能技术的飞速发展,开源大模型已逐渐成熟。将大模型部署在本地电脑上,不仅能实现数据隐私保护,还能避免网络延迟和 API 调用成本。本文将详细介绍如何在本地环境部署和运行开源大模型。

环境准备

在开始部署之前,请确保您的硬件满足以下基本要求:

- 操作系统:Windows 10/11, macOS (Intel/Apple Silicon), Linux (Ubuntu/CentOS 等)。

- 内存 (RAM):建议至少 16GB,推荐 32GB 以上。

- 显卡 (GPU):NVIDIA 显卡为佳,显存建议 8GB 以上(如 RTX 3060/4070)。若使用 CPU 推理,速度会较慢但无需特定 GPU。

- 硬盘空间:根据模型大小预留,通常单个模型需 5GB-50GB 不等。

安装 Ollama

Ollama 是一个轻量级的工具,用于在本地运行大语言模型。它支持多种操作系统,安装简单且易于管理。

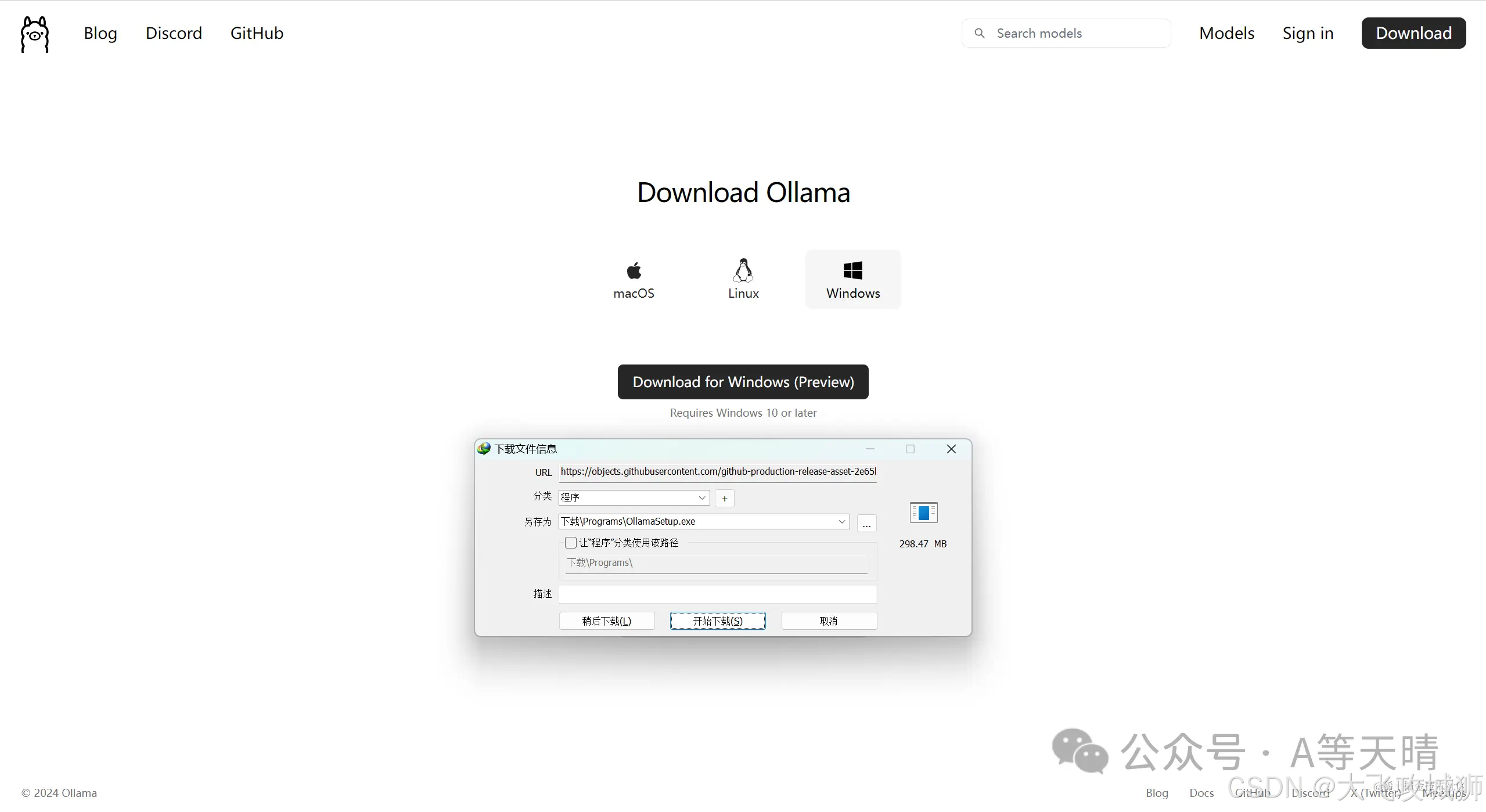

Windows 安装

- 访问 GitHub 项目页面:https://github.com/ollama/ollama

- 下载适用于 Windows 的安装包并运行。

- 安装完成后,打开命令行窗口(CMD 或 PowerShell)。

- 输入

ollama命令验证安装是否成功。如果显示帮助信息,则说明安装无误。

macOS / Linux 安装

在终端中执行以下命令进行安装:

curl -fsSL https://ollama.com/install.sh | sh

安装后同样通过 ollama serve 启动服务,或使用 ollama 命令检查版本。

下载与运行模型

Ollama 提供了丰富的开源模型库,包括 Llama 3、Mistral、Gemma 等。

拉取模型

在命令行中输入以下命令拉取模型(以 llama3.1 为例):

ollama pull llama3.1

系统会自动从服务器下载模型文件并缓存到本地。不同版本的模型占用空间不同,例如量化版(Q4_K_M)比原始 FP16 版本小得多。

对话测试

模型下载完成后,即可直接进行对话:

ollama run llama3.1

进入交互模式后,输入问题即可获得回答。按 Ctrl+D 退出会话。

删除模型

如需释放空间,可使用以下命令删除模型:

ollama rm llama3.1

性能优化与注意事项

- 资源占用:运行大模型对显存和内存要求较高。如果同时运行多个模型,可能会导致系统卡顿甚至死机。建议单台设备仅运行一个大型模型。

- 模型选择:根据硬件配置选择合适的模型。例如,8GB 显存的显卡适合运行 7B-13B 参数的模型;405B 参数的大模型需要极高的硬件配置(如多卡 A100 或大量 RAM)。

- 量化技术:为了降低资源需求,推荐使用量化后的模型(如 Q4_0, Q5_K_M),它们在保持大部分智能的同时显著减少内存占用。

可视化界面 (GUI)

虽然命令行功能强大,但对于普通用户,图形界面更友好。可以使用 GPT4All 或其他兼容 Ollama 的客户端。