Llama3 中文模型微调与部署实战指南

本教程基于 RockyLinux 8 版本环境,适用于单机 4090Ti 24G 显存场景。训练过程中 GPU 显存占用约为 23G。通过本文档,您可以完整掌握从模型下载、数据准备、LoRA 微调、模型合并到本地化部署的全流程。

1. 环境准备与模型下载

1.1 硬件与软件要求

- 操作系统: RockyLinux 8 / CentOS 7+

- GPU: NVIDIA RTX 4090 (24GB VRAM) 或同等性能显卡

- Python: 建议 Python 3.10 及以上

- CUDA: 确保驱动支持 CUDA 11.8 或更高版本

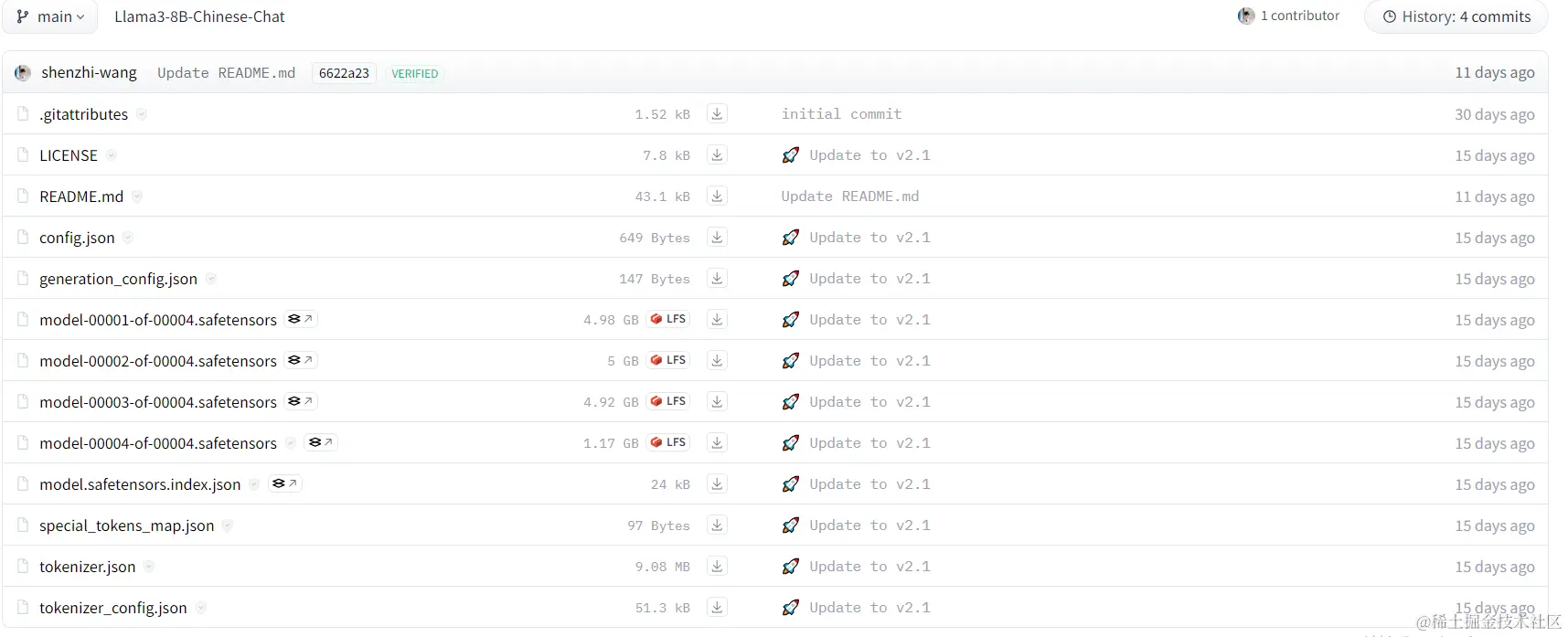

1.2 下载中文模型

下载训练好的 Llama3-8B 版本中文模型。推荐使用 HuggingFace 上的开源中文适配版本。

存放路径: /data/dataset/model/llama3/8b-chinese-chat

注意:请确保模型文件完整性,建议校验 SHA256 值。

2. 使用 LLaMA-Factory 进行微调和部署

LLaMA-Factory 是一个高效的大模型微调工具,支持多种训练策略(如 LoRA, QLoRA)。

2.1 安装 LLaMA-Factory

# 建立存放目录

mkdir -p /data/dataset/project

cd /data/dataset/project

# 克隆仓库,注意版本 v0.6.1 稳定性较好

git clone https://github.com/hiyouga/LLaMA-Factory.git

cd LLaMA-Factory-0.6.1

# 安装依赖

pip install -r requirements.txt

2.2 准备训练数据

进入数据目录并添加自定义指令数据。

cd /data/dataset/project/LLaMA-Factory-0.6.1/data

创建 stock.json 文件,格式需符合 JSON Lines 或标准 JSON 列表结构。示例如下:

[

{

"instruction": "请给出以下区域板块包含的个股名称和代码,使用;隔开",

"input": "贵州",

"output": "贵州茅台 600519;"

}