本地部署 Deepseek-r1 模型指南

引言

随着大语言模型(LLM)技术的快速发展,Deepseek-r1 作为国产优秀的推理模型,其能力已对标国际主流水平。将模型部署到本地环境,不仅能保障数据隐私,还能实现完全离线的 AI 交互体验。本文详细介绍如何使用 Ollama 和 Chatbox 在本地完成 Deepseek-r1 的部署、配置及日常使用。

一、环境准备

1. 硬件要求

本地运行大模型对硬件有一定要求,尤其是显存(VRAM)。

- 推荐配置:NVIDIA 显卡,显存至少 8GB(适合 7B 版本),建议 16GB 以上(可运行 14B 或更高版本)。

- 内存:系统内存建议 16GB 起步,32GB 更佳。

- 存储:模型文件占用空间较大,7B 量化版约需 5-6GB 硬盘空间,请预留充足 SSD 空间。

- 操作系统:支持 Windows 10/11, macOS (Apple Silicon), Linux (Ubuntu/CentOS)。

2. 软件依赖

- Ollama:用于加载和管理本地大模型的开源工具。

- Chatbox:一款简洁易用的本地大模型图形界面客户端。

二、安装 Ollama

Ollama 是运行本地模型的核心后端服务。

1. 下载与安装

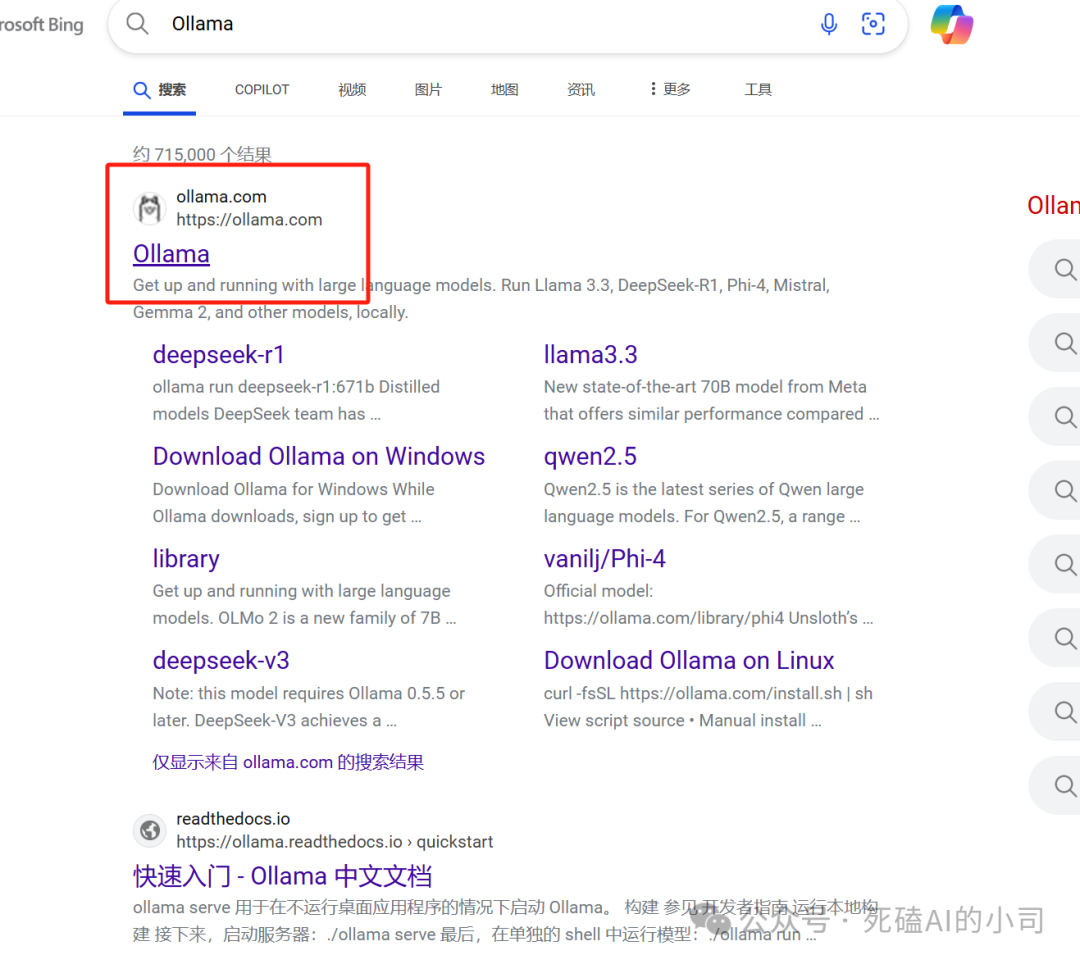

访问 Ollama 官网下载对应操作系统的安装包。安装过程中无需复杂配置,默认会自动启动后台服务。

2. 验证安装

打开命令行终端(Windows PowerShell / CMD, macOS Terminal, Linux Bash),输入以下命令检查版本:

ollama --version

若显示版本号,说明安装成功。此时后台服务应已在运行。

三、拉取并运行 Deepseek-r1 模型

1. 选择模型版本

Deepseek-r1 提供多种参数量级,根据硬件资源选择:

- 1.5B / 7B:适合 8GB 显存笔记本,速度快,响应流畅。

- 14B / 32B:适合 16GB+ 显存桌面端,推理能力更强。

- 70B:需要专业级显卡或多卡环境。

本教程以 7B 版本为例,平衡性能与兼容性。

2. 拉取模型

在命令行中执行以下指令拉取模型:

ollama run deepseek-r1:7b

首次运行会自动从网络下载模型权重文件。若下载中断,可再次执行相同命令继续下载。

3. 测试对话

模型加载完成后,即可直接在终端进行对话。例如:

>>> 你好

你好!很高兴见到你,有什么我可以帮忙的吗?

>>> 普通人在 AGI 到来之前,需要如何保持自己在社会中的竞争力以及如何制定学习计划。

面对人工智能技术尤其是通用人工智能(AGI)的到来,普通人需要从技术能力、软技能、职业规划等多个方面入手...(此处省略详细回答内容)...

四、配置图形化界面 Chatbox

虽然命令行可用,但图形界面更适合日常交互。Chatbox 支持连接本地 Ollama 服务。