Llama3 中文大模型快速部署与优化指南

背景介绍

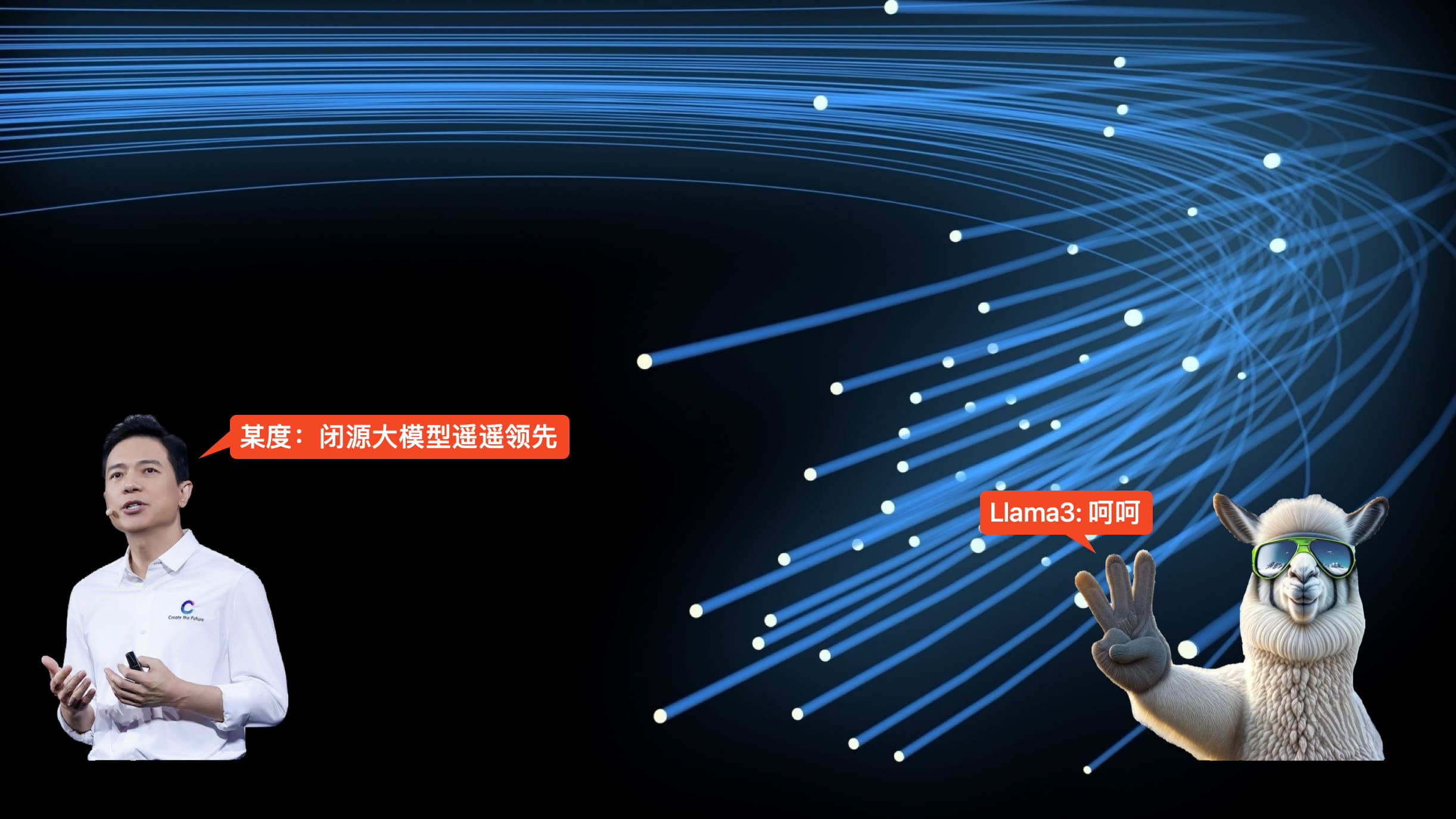

Meta 于美国当地时间 4 月 18 日正式发布了 Llama3 系列开源大模型,包含 80 亿 (8B) 和 700 亿 (70B) 参数版本。这两款模型在同等参数量下展现了卓越的性能,直接逼近了 GPT-4 和 Claude3 等顶级商业模型的水平。随着开源生态的活跃,HuggingFace 上迅速涌现了大量针对中文场景微调的版本,为本地化部署提供了丰富的选择。

对于开发者而言,如何在有限的硬件资源下快速部署并运行这些模型,是当前的核心需求。本文将详细介绍从模型选型、量化策略到本地环境搭建的全流程方案。

模型选型与量化策略

1. 模型版本选择

目前效果较好的中文微调版模型包括 HuggingFace 社区中的 zhouzr/Llama3-8B-Chinese-Chat-GGUF。该模型基于 firefly-train-1.1M、moss-003-sft-data、school_math_0.25M 以及弱智吧数据集进行训练,显著提升了中文对话的理解与生成能力。

2. 量化技术解析

为了在 CPU 或显存有限的设备上运行大模型,量化(Quantization)是关键技术。不同的量化方法会带来不同程度的性能损失:

- 8bit 量化:几乎没有性能损失,适合对精度要求极高的场景。

- AWQ 4bit 量化:对 8B 模型约 2% 性能损失,对 70B 模型仅 0.05% 损失,性价比极高。

- 低比特量化:参数越大的模型,低 bit 量化损失越低。例如 AWQ 3bit 70B 模型损失约为 2.7%,完全可接受。

推荐配置:

- 追求无损:8B 模型使用 8bit 量化,70B 模型使用 4bit 量化。

- 追求速度:8B 模型使用 4bit 量化,70B 模型使用 3bit 量化。

本地环境部署方案

方案一:使用 Ollama(推荐新手)

Ollama 是一个轻量级的本地大模型运行工具,支持一键拉取和运行。

1. 安装 Ollama

访问官网下载对应操作系统的安装包,或使用命令行安装:

# macOS / Linux

brew install ollama

# Windows

winget install Ollama.Ollama

2. 拉取模型

启动服务后,通过命令行拉取中文微调模型:

ollama pull zhouzr/llama3-8b-chinese-chat:q4_k_m

3. 启动服务

ollama serve

默认监听端口为 11434。

方案二:使用 llama.cpp(高性能)

llama.cpp 提供了基于 C/C++ 的高性能推理引擎,适合对延迟敏感的场景。

1. 编译环境

确保已安装 CMake 和 GCC/G++:

sudo apt-get update

sudo apt-get install cmake build-essential

2. 克隆源码

git clone https://github.com/ggerganov/llama.cpp.git

cd llama.cpp

build && build

cmake ..

make -j$()