本地部署大模型:Ollama 部署与实战指南

前言

在云端大模型服务之外,本地部署大语言模型(LLM)提供了数据隐私保护、离线可用及低延迟响应的优势。Ollama 是一款专为本地机器便捷部署和运行大模型而设计的工具,配合 Open WebUI 等前端界面,可构建完整的私有化 AI 应用环境。

本文将从零开始,详细介绍 Ollama 在不同操作系统下的安装、配置、模型管理及 API 调用方法。

一、环境准备

在部署前,请确保硬件满足以下基本要求:

| 组件 | 最低要求 | 推荐配置 |

|---|---|---|

| CPU | 4 核以上 | 8 核以上 |

| RAM | 8GB | 16GB - 32GB |

| GPU | 无 (CPU 推理) | NVIDIA GPU (支持 CUDA) |

| 磁盘 | 5GB 可用空间 | 50GB+ SSD |

注意:模型运行主要依赖内存带宽。若使用量化模型(如 Q4_K_M),7B 参数模型约需 5-6GB 显存/内存,13B 约需 8-10GB。

二、部署方案

1. 客户端直接安装

适用于 macOS 和 Windows 桌面用户。

- macOS: 访问官网下载

Ollama-darwin.zip并解压安装。 - Windows: 下载

OllamaSetup.exe运行安装程序。

安装完成后,终端输入 ollama -v 检查版本。

2. Linux 服务器裸机部署

推荐使用 Linux 服务器以获得更好的性能稳定性。

2.1 安装与启动

使用官方脚本一键安装:

curl -fsSL https://ollama.com/install.sh | sh

安装成功后,系统会自动创建 systemd 服务。查看服务状态:

systemctl status ollama

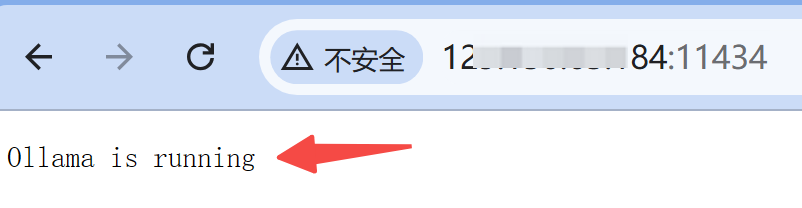

若显示 active (running),则服务正常。

2.2 配置修改

默认配置仅允许本地访问。如需局域网访问或更改存储路径,需编辑 /etc/systemd/system/ollama.service。

开启局域网访问:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

修改模型存储位置:

=