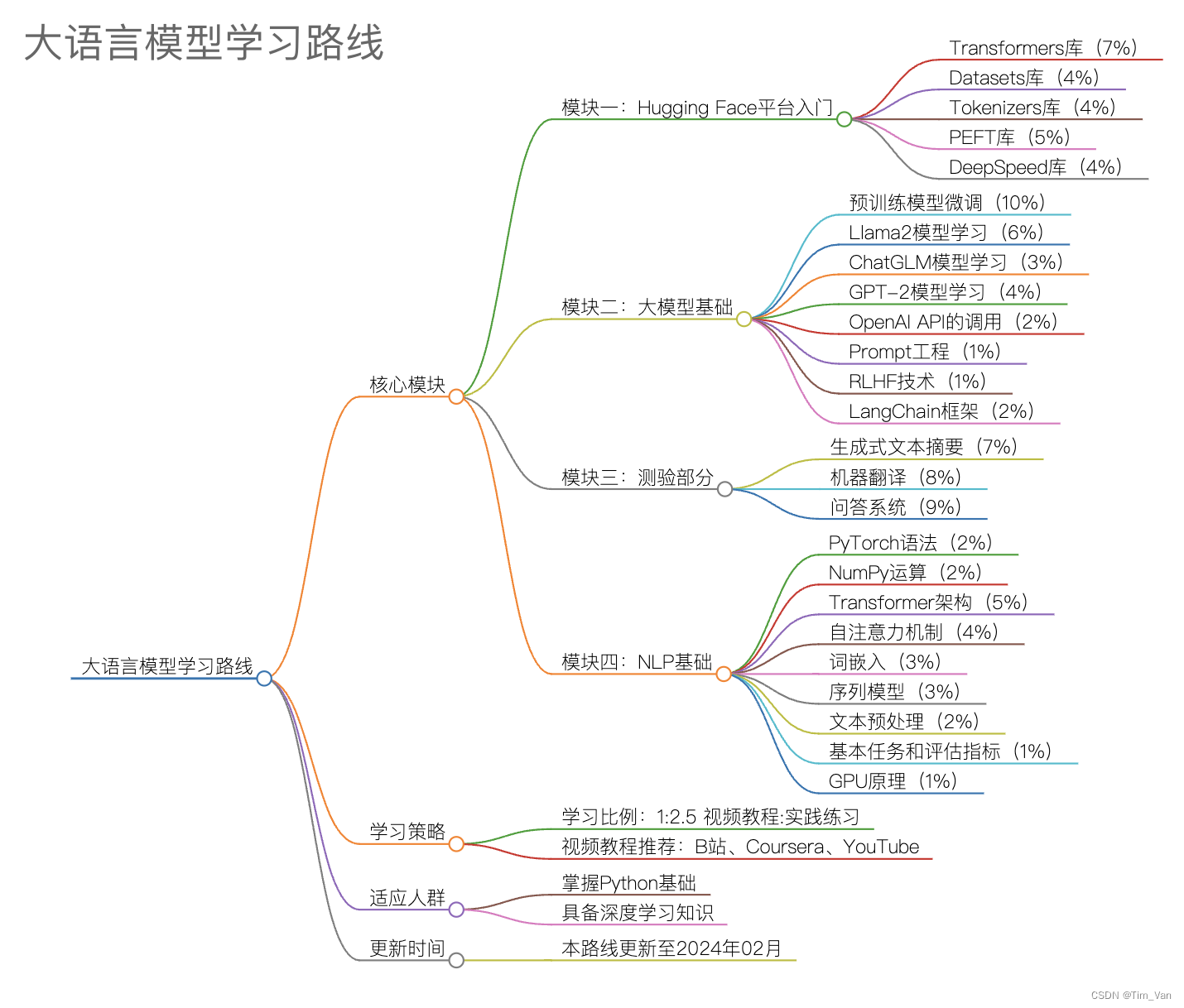

大语言模型学习路线:从入门到实战

在人工智能领域,大语言模型(Large Language Models, LLMs)正迅速成为核心热点。本学习路线旨在为具备基本 Python 编程和深度学习基础的学习者提供一个清晰、系统的大模型学习指南,帮助你在这一领域快速成长。

适应人群

- 已掌握 Python 基础语法及常用库

- 具备基本的深度学习知识(如神经网络、反向传播)

学习原则

- 模块顺序:本路线包含四个核心模块。若基础薄弱,建议优先学习模块四(NLP 基础),再依次推进。

- 实践比例:遵循 1:2.5 规则,即每观看或阅读一部分理论知识后,应至少投入 2.5 倍的时间进行代码实践与实验。

- 内容占比:百分号表示该部分内容在整个学习路径中的权重,例如'Transformers 库(7%)'表示该部分占整体进度的 7%。

模块一:Hugging Face 平台入门

Hugging Face 是目前最流行的开源 AI 社区之一,提供了丰富的预训练模型和工具链。

Transformers 库(7%)

理解如何使用 Transformers 进行模型的加载、推理和微调。这是进入 LLM 开发的核心入口,需掌握 AutoModel、pipeline 等关键类的使用。

Datasets 库(4%)

学习如何处理大规模文本数据。包括数据的流式读取、清洗、格式化以及构建自定义数据集对象,为模型训练提供高质量输入。

Tokenizers 库(4%)

学习如何进行有效的文本分词。理解 BPE(Byte Pair Encoding)、WordPiece 等算法原理,掌握如何将原始文本转换为模型可理解的 token ID 序列。

PEFT 库(5%)

掌握模型参数高效微调技术。重点学习 LoRA(Low-Rank Adaptation)等方法,了解如何在有限算力下对大模型进行适配,减少显存占用并加速训练。

DeepSpeed 库(4%)

了解模型加速训练的底层技术。包括 ZeRO 优化器、梯度累积、混合精度训练等,用于解决大模型分布式训练中的显存瓶颈问题。

模块二:大模型基础

深入理解大模型的核心架构与应用模式。

预训练模型微调(10%)

学习如何根据自己的特定数据集微调模型。区分全量微调与参数高效微调,掌握 SFT(Supervised Fine-Tuning)流程,使通用模型适应垂直领域任务。

Llama2 模型学习(6%)

重点关注 Meta 发布的 Llama2 系列。分析其分词器特性、输入输出具体格式(System/User/Assistant)、模型结构差异(Decoder-only)及应用限制。

ChatGLM 模型学习(3%)

研究智谱 AI 的 ChatGLM 系列。了解其在中文场景下的优化表现,以及多轮对话的历史上下文管理机制。

GPT-2 模型学习(4%)

作为早期代表性模型,学习 GPT-2 的生成机制。通过对比现代大模型,理解 Transformer Decoder 架构的演进历程。

OpenAI API 的调用(2%)

学习如何使用常见的大语言模型接口。掌握 RESTful API 的请求构造、Token 计费计算、速率限制处理及错误重试机制。

Prompt 工程(1%)

学习模型的使用技巧。包括零样本(Zero-shot)、少样本(Few-shot)提示设计,以及思维链(Chain-of-Thought)等高级提示策略,以激发模型潜能。

RLHF 技术(1%)

学习高级模型训练技术。理解人类反馈强化学习(Reinforcement Learning from Human Feedback)的基本流程,包括奖励模型训练与 PPO 优化过程。