基于 DeepSeek-R1 与 AnythingLLM 构建本地私有知识库指南

引言

在使用 DeepSeek 或其他大语言模型时,用户常面临两个核心痛点:一是知识迭代滞后,官方模型训练数据截止于过去某个时间点,无法获取最新行业信息;二是数据隐私风险,将敏感文档上传至云端存在泄露隐患。

通过构建本地私有知识库(RAG, Retrieval-Augmented Generation),可以有效解决上述问题。利用本地部署的 DeepSeek-R1 模型配合 AnythingLLM 工具,可以实现以下优势:

- 实时性:本地知识库可即时更新,无需等待模型重新训练。

- 隐私安全:所有数据存储在本地硬盘,不经过第三方服务器。

- 成本可控:利用个人电脑硬件资源,无需支付高昂的 API 调用费用。

本文将详细介绍如何利用 DeepSeek-R1 模型的能力,借助 Ollama 与 AnythingLLM 两个开源工具,在 Windows 环境下实现个人知识库的构建与使用。

一、环境准备与系统要求

在开始部署之前,请确保您的计算机满足以下最低配置要求,以保证运行流畅:

- 操作系统:Windows 10/11 (64 位) 或 macOS / Linux

- 内存 (RAM):建议 16GB 及以上(8GB 可运行小模型但体验受限)

- 显存 (VRAM):NVIDIA GPU 推荐 6GB 以上(若使用 CPU 推理需更大内存)

- 存储空间:预留至少 20GB 用于模型文件及向量数据库存储

- 网络:首次下载模型需要稳定网络连接

二、Ollama 本地部署 DeepSeek-R1 模型

Ollama 是一个轻量级的本地大模型运行框架,支持一键拉取和运行多种开源模型。

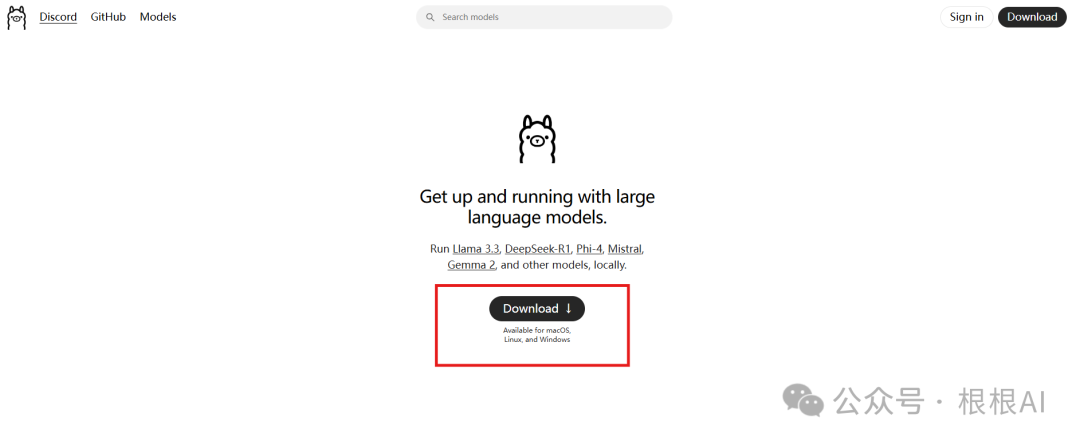

1. 安装 Ollama

访问 Ollama 官网 https://ollama.com/,点击 Download 按钮。根据电脑系统选择相应的版本进行下载。

注意:若下载速度过慢,可尝试更换镜像源或使用官方提供的国内加速链接。

打开下载的安装包,点击 Install,按照向导完成安装。安装完成后,按 Win + R 键,输入 cmd 调出命令行窗口。

输入以下命令检查安装是否成功:

ollama --version

若出现版本号输出,则表明安装成功。

2. 拉取并运行 DeepSeek-R1 模型

DeepSeek-R1 提供了不同参数量级的版本,用户可根据硬件性能选择。例如,显存为 6G 的笔记本可选择最小的 1.5b 模型;若显存更大,建议选择 7b 或更高版本以获得更好的回复质量。

在命令行窗口中输入以下命令启动模型:

ollama run deepseek-r1:1.5b

按下回车后,模型开始自动下载。下载进度会在终端显示。

模型下载成功后,自动进入对话模式。此时可以在命令行中与模型进行交互测试,验证模型是否正常响应。

3. 常用管理命令

为了便于后续维护,建议熟悉以下 Ollama 常用命令:

- 查看已下载的模型列表:

ollama list - 删除指定模型:

ollama rm <model_name> - 后台运行服务:

ollama serve

三、AnythingLLM 的下载与配置

AnythingLLM 是一款功能强大的桌面端 RAG 应用,能够轻松连接本地模型并管理知识库。