Langchain-Chatchat 本地知识库搭建与部署教程

本文介绍如何在 Google Colab 环境中使用 Langchain-Chatchat 搭建一个基于本地知识库的问答应用。该方案支持中文场景,兼容开源模型,且可离线运行。

什么是 Langchain-Chatchat?

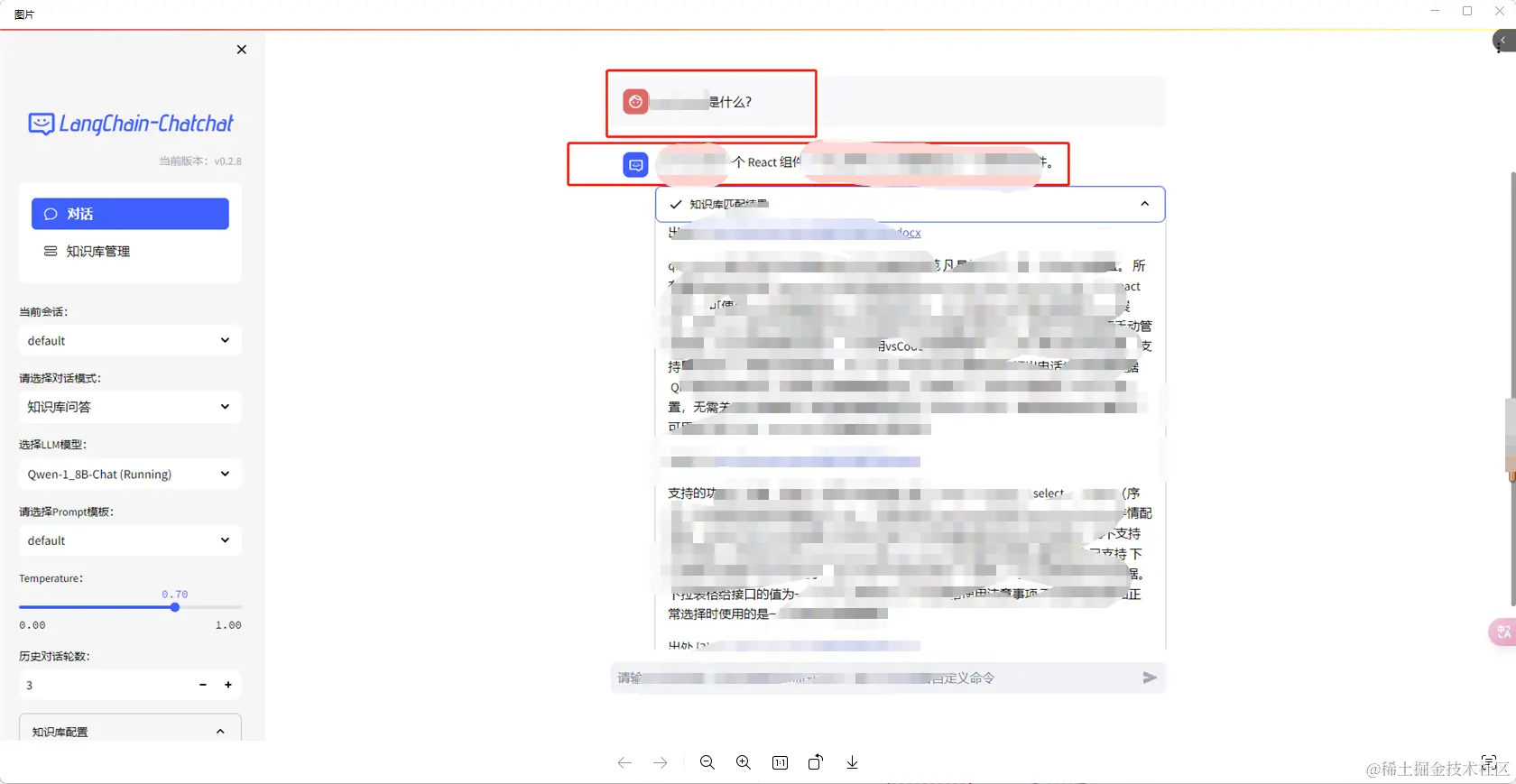

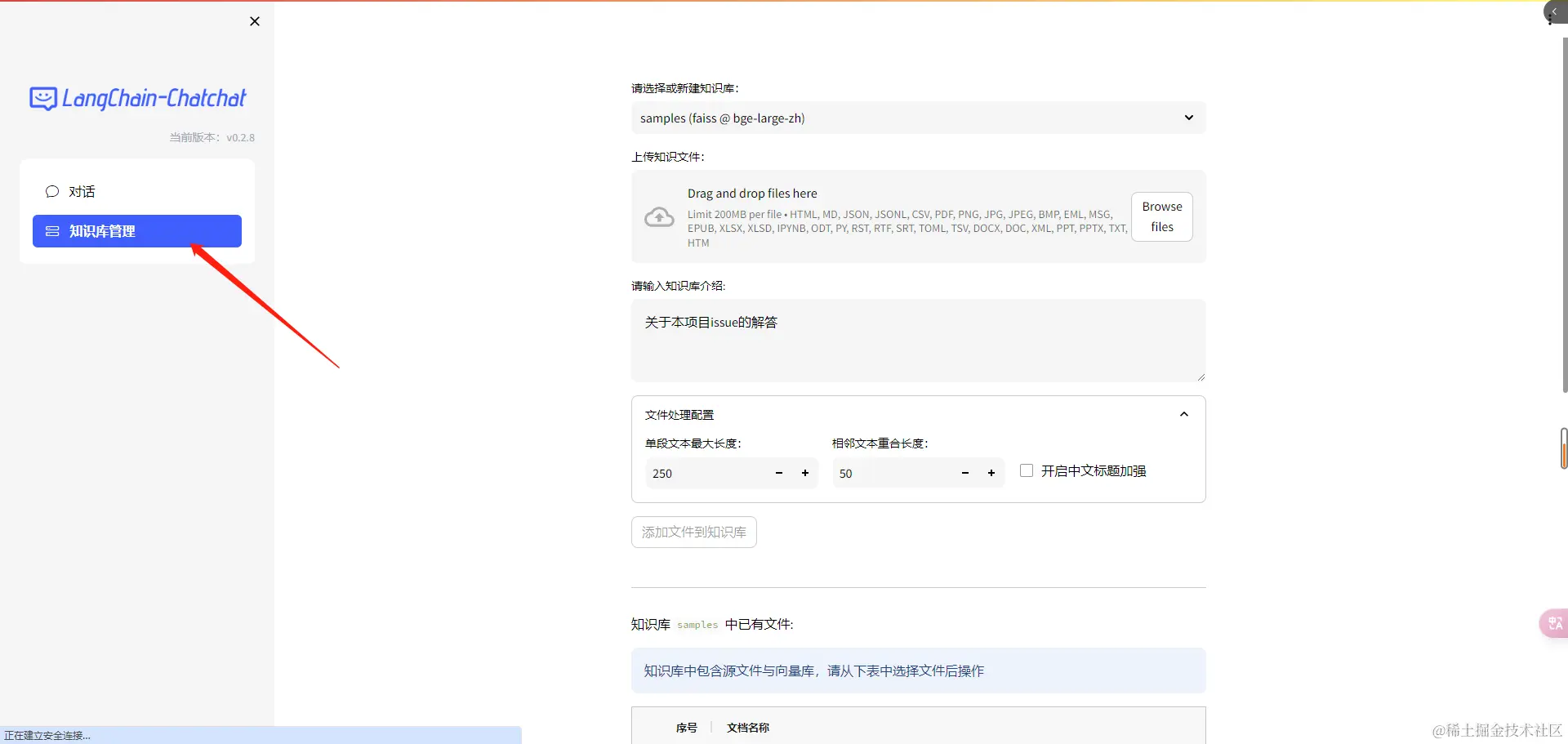

Langchain-Chatchat 是一个基于 Langchain 思想实现的本地知识库问答应用。它旨在建立一套对中文场景与开源模型支持友好、可离线运行的知识库问答解决方案。通过集成大语言模型(LLM)和向量数据库,用户可以上传文档并与其进行自然语言交互。

运行起来后,您可以上传各种文档文件到知识库,并进行智能问答。

环境准备:Google Colab

由于是在 Google Colab(原 Google 实验室)上运行代码,本地电脑配置要求较低,无需担心硬件限制。Colab 笔记本环境中默认已经安装了 nodejs、python 等基础环境。

新建 Notebook

- 打开 Google Drive 地址(需网络环境支持)。

- 在

colab notebooks目录下新增笔记文件即可。

基本语法

- 在代码单元格前面加上

!符号表示执行系统命令。 %cd用于切换当前工作目录。

详细部署步骤

1. 拉取项目仓库

首先克隆 Langchain-Chatchat 官方仓库到 Colab 的工作目录中。

!git clone https://github.com/chatchat-space/Langchain-Chatchat.git

2. 切换至项目目录

将当前工作目录切换到刚克隆的项目文件夹下。

repo_dir = "/content/Langchain-Chatchat"

%cd $repo_dir

3. 修改配置文件

Google Colab 的免费 GPU 资源有限,默认的 chatglm3-6b 模型可能无法顺利运行。建议更换为参数量较小的模型,例如 Qwen-1_8B-Chat。

a. 修改模型配置

打开文件 configs/model_config.py.example,找到第 22 行左右,将 LLM_MODELS 列表修改为包含小参数模型:

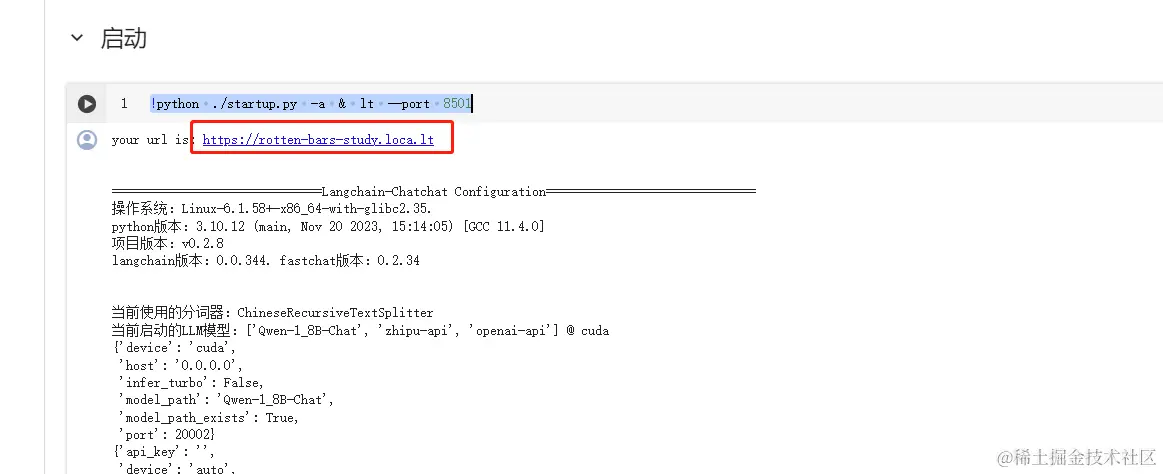

LLM_MODELS = ["Qwen-1_8B-Chat", "zhipu-api", "openai-api"]