大语言模型(LLM)详解

一、定义

Large Language Model,简称 LLM,即大规模语言模型或大型语言模型。它是一种基于海量数据训练的统计语言模型,主要用于生成和翻译文本及其他内容,并执行各类自然语言处理任务(NLP)。LLM 通常基于深度神经网络构建,包含数百亿甚至数千亿参数,采用自监督学习方法通过大量无标注文本进行训练。

大语言模型(LLM)是基于海量数据训练的统计语言模型,通常包含数百亿参数,用于生成和翻译文本及执行 NLP 任务。本文详细阐述了 LLM 的定义、发展历程(从 n-gram 到 Transformer)、核心特点(如涌现能力、多模态支持)、文件结构解析、工作原理(自注意力机制)、应用场景及优缺点。同时提供了基于 Python 的代码示例,并给出了从基础理解到私有化部署的系统学习路径建议,帮助读者全面掌握大模型技术。

Large Language Model,简称 LLM,即大规模语言模型或大型语言模型。它是一种基于海量数据训练的统计语言模型,主要用于生成和翻译文本及其他内容,并执行各类自然语言处理任务(NLP)。LLM 通常基于深度神经网络构建,包含数百亿甚至数千亿参数,采用自监督学习方法通过大量无标注文本进行训练。

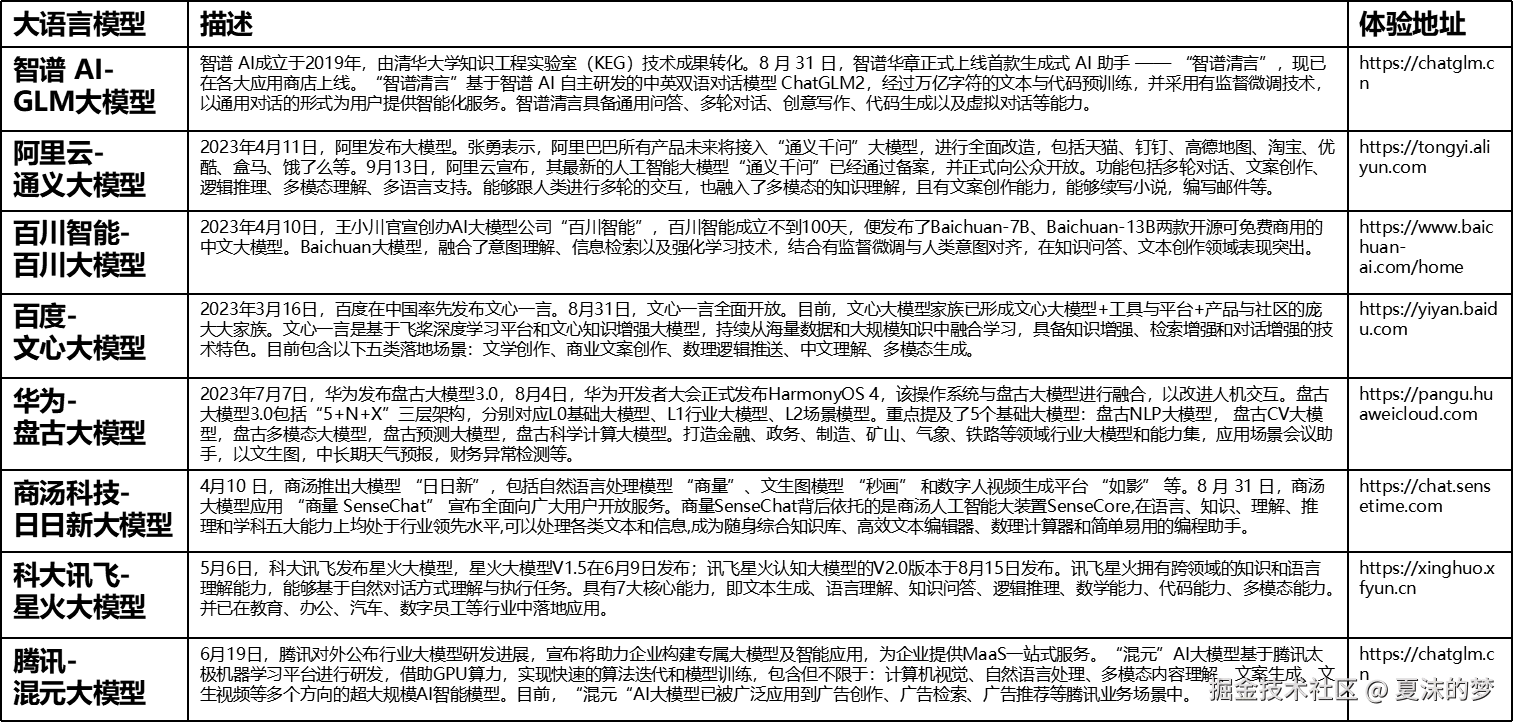

目前主流的 LLM 包括国外的 GPT-3、GPT-4、PaLM、Galactica 和 LLaMA 等,以及国内的 ChatGLM、文心一言、通义千问、讯飞星火等。

一个典型的开源 LLM 项目通常包含以下关键文件:

ChatGLMConfig)。ChatGLMForConditionalGeneration 类)。ChatGLMTokenizer)。LLM 在 NLP 任务中具有广泛应用:

LLM 通常基于 Transformer 架构,核心依赖于自注意力机制(Self-Attention)处理输入序列。工作流程如下:

使用 LLM 通常涉及以下步骤:

transformers, torch, accelerate 等。以下是一个使用 Hugging Face transformers 库加载模型并进行简单推理的示例:

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

# 1. 加载模型和分词器

model_name = "THUDM/chatglm3-6b" # 示例模型

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(model_name, trust_remote_code=True).half().cuda()

# 2. 准备输入

input_text = "你好,请介绍一下你自己。"

inputs = tokenizer(input_text, return_tensors="pt").to(model.device)

# 3. 生成输出

outputs = model.generate(**inputs, max_length=1024)

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(response)

优点:

缺点:

为了系统掌握大模型技术,建议按以下阶段进行学习:

通过上述路径,开发者可以逐步从理论认知过渡到工程实践,构建基于大模型的创新应用。

微信公众号「极客日志」,在微信中扫描左侧二维码关注。展示文案:极客日志 zeeklog

使用加密算法(如AES、TripleDES、Rabbit或RC4)加密和解密文本明文。 在线工具,加密/解密文本在线工具,online

生成新的随机RSA私钥和公钥pem证书。 在线工具,RSA密钥对生成器在线工具,online

基于 Mermaid.js 实时预览流程图、时序图等图表,支持源码编辑与即时渲染。 在线工具,Mermaid 预览与可视化编辑在线工具,online

解析常见 curl 参数并生成 fetch、axios、PHP curl 或 Python requests 示例代码。 在线工具,curl 转代码在线工具,online

将字符串编码和解码为其 Base64 格式表示形式即可。 在线工具,Base64 字符串编码/解码在线工具,online

将字符串、文件或图像转换为其 Base64 表示形式。 在线工具,Base64 文件转换器在线工具,online