OpenAI o1 大模型研究进展报告

在人工智能领域掀起巨浪的 OpenAI o1 模型发布三周后,一支由高校年轻研究者组成的团队发布了题为'o1 Replication Journey: A Strategic Progress Report (o1 探索之旅:战略进展报告)'的研究进展报告。

这份报告的独特之处在于:

- 提出并验证了'旅程学习'技术的巨大潜力:通过 327 条训练样本,鼓励模型学会反思、纠错、回溯,其在复杂数学题目上表现绝对性能超过了传统监督学习 8% 以上,相对性能提升超过 20%。

- 前所未有的透明度和即时性,详细记录了团队在复现过程中的发现、挑战、试错和创新方法,倡导了一种全新的 AI 研究范式。

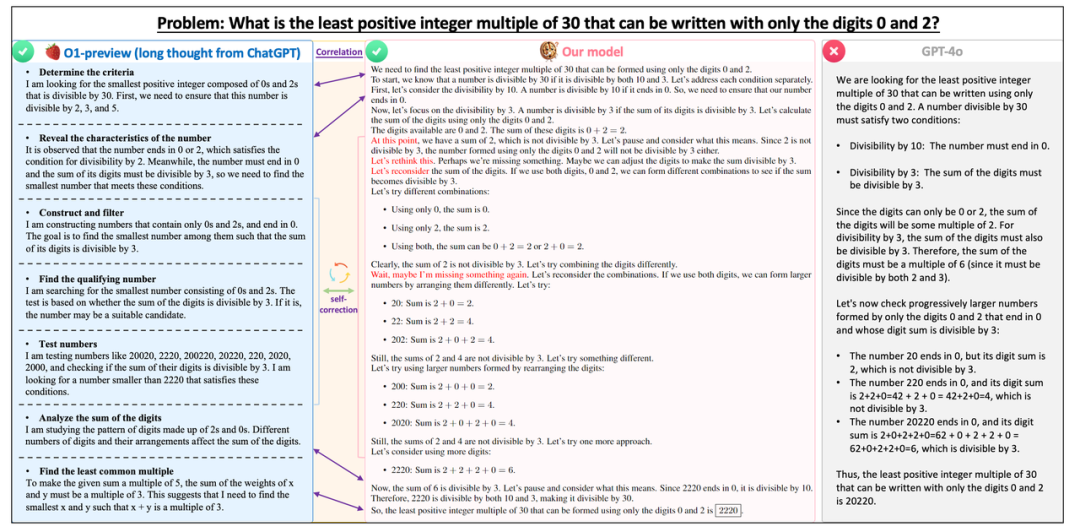

团队提出的模型在同一道数学题上,与 OpenAI 的 o1-preview(答对)及 GPT-4o(答错)的比较实例,证明旅程学习不断试错、反思、自我纠正的能力在复杂推理任务场景上非常关键。

技术报告链接:https://github.com/GAIR-NLP/O1-Journey/blob/main/resource/report.pdf Github 链接:https://github.com/GAIR-NLP/O1-Journey o1 讨论资源:https://github.com/GAIR-NLP/O1-Journey/tree/main/resource

团队核心开发主要由上海交通大学 GAIR 研究组的本科三年级、四年级学生以及直博一年级研究生组成,项目得到了来自 NYU 等一线大型语言模型领域顶尖研究科学家的指导。

从'捷径学习'到'旅程学习',从'浮光掠影'到'深耕细作'

团队认为,大多数现有的机器学习或大模型训练方法(如监督式微调)都可以被归类为'捷径学习'(Shortcut Learning),即模型学习到达正确答案的直接路径。这种传统范式虽然在特定、明确定义的任务中可能有效,但在面对复杂、动态和开放性问题时显示出明显的局限性。

捷径学习具有以下关键特征:

- 注重快速结果:强调在短时间内达到特定的性能指标。

- 高度依赖数据:性能改进通常依赖于增加训练数据量。

- 泛化能力有限:在训练数据分布之外的场景中,性能可能会急剧下降。

- 缺乏自我纠正能力:这些系统通常缺乏识别和纠正自身错误的能力。

认识到这些缺点,本文提出了一种名为'旅程学习'(Journey Learning) 的新范式。旅程学习旨在使人工智能系统能够通过学习、反思、回溯和适应不断进步,就像人类一样,从而展现出更高水平的智能。

图:从'捷径学习'到'旅程学习'的范式转变。这是一个用于推理任务的搜索树。对于数学问题解决任务,根节点代表初始问题,而叶节点则是最终结论。绿色节点表示正确答案,红色节点表示错误答案。

仅使用 327 个训练样本,不借助任何额外训练技巧,旅程学习在 MATH 数据集上的表现就超过了传统监督学习 8% 以上,展示了其极其强大的潜力。作者也认为这是 o1 技术中最关键的组成部分。