1. 介绍

Transformers 是由 Hugging Face 开发的一个深度学习库,提供了数千个预训练模型,支持文本、视觉和音频处理任务。该库基于 Jax、PyTorch 和 TensorFlow 三大主流深度学习框架,广泛应用于自然语言处理(NLP)、计算机视觉(CV)及语音识别领域。

主要功能模块

- 文本类:支持文本分类、信息提取、问答系统、摘要生成、机器翻译和文本生成等任务,涵盖多种语言。

- 图像类:包括图像分类、目标检测、图像分割等功能。

- 音频类:涵盖语音识别、音频分类等场景。

- 多模态结合:支持表格问答、光学字符识别(OCR)、视频分类及视觉回答等复杂任务。

2. 环境安装

检查 Python 版本

确保使用 Python 3.7 或更高版本:

python --version

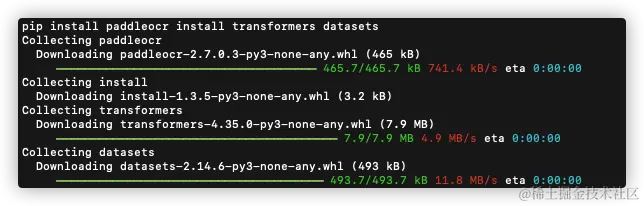

安装核心依赖

Transformers 和 Datasets 是核心库,建议通过 pip 安装:

pip install transformers datasets

安装深度学习框架

根据项目需求选择 PyTorch 或 TensorFlow:

# PyTorch 安装

pip install torch

# TensorFlow 安装

pip install tensorflow

注意:PyTorch 具有动态计算图特性,适合快速原型开发;TensorFlow 则在企业级部署中表现稳定。安装完成后,可使用

pip list验证库是否已正确安装。

3. 核心组件与使用

Pipeline 管道

Pipeline 是 Transformers 提供的最便捷接口,封装了预处理、推理和后处理流程,适用于快速测试不同任务。

| 类型 | 任务 | 描述 | 标识符 |

|---|---|---|---|

| NLP(文本类) | 情绪分析 | 分析文本情感倾向 | pipeline(task="sentiment-analysis") |

| NLP(文本类) | 文本生成 | 根据提示生成连贯文本 | pipeline(task="text-generation") |

| NLP(文本类) | 摘要生成 | 生成长文档的摘要 | pipeline(task="summarization") |

| 视觉图像类 | 图像分类 | 识别图片中的物体类别 | pipeline(task="image-classification") |

| 视觉图像类 | 目标检测 | 预测对象位置及类别 | pipeline(task="object-detection") |

| 视觉图像类 | 图片转标题 | 为图像生成描述性标题 | pipeline(task="image-to-text") |

| 音频类 | 音频分类 | 对音频场景进行分类 |