Windows 平台本地 RAG 服务构建:Dify + Ollama + Qwen2.5 部署实践

在构建基于大语言模型(LLM)的检索增强生成(RAG)服务时,数据隐私和成本控制往往是企业关注的重点。为了在不依赖云端 API 的情况下实现私有化部署,采用 Dify 作为应用开发平台,结合 Ollama 管理本地大模型,并接入 Qwen2.5 与 Embedding 模型,是一个高效且灵活的方案。

主要工具介绍

Dify

Dify 是一款开源的大语言模型应用开发平台。它提供了可视化的操作界面,集成了 AI 工作流、RAG 管道、代理功能、模型管理及可观察性功能,支持从原型开发快速过渡到生产环境。

Ollama

Ollama 是一个开源的大模型管理工具,专注于本地模型的运行与管理。它简化了大模型的部署流程,支持多种主流模型格式,能够显著提高本地模型的推理速度和部署效率。

Qwen2.5

Qwen2.5 是通义千问团队最新开源的系列模型,涵盖 0.5B 至 72B 多种参数规模。该模型在预训练阶段使用了大规模数据集,包含多达 18 万亿个 tokens,在自然语言理解、文本生成、编程及数学能力上均有显著提升。

Docker

Docker 是一种轻量级的虚拟化技术及应用容器运行环境搭建平台。通过 Docker,开发者可以将应用及其依赖打包到一个可移植的容器中,并在 Linux 或 Windows 等系统上便捷运行。

部署 Dify

系统要求

在安装 Dify 之前,请确保您的机器满足以下最低系统要求:

- CPU >= 2 Core

- RAM >= 4GB

快速部署步骤

推荐使用 Docker Compose 进行一键部署。

- 克隆源代码:将 Dify 源代码克隆至本地。

git clone https://github.com/langgenius/dify.git - 进入目录:进入 docker 配置目录。

cd dify/docker - 配置环境变量:复制默认的环境变量文件。

cp .env.example .env - 启动服务:使用默认端口,一键启动所有服务。

docker compose up -d

部署成功后,可通过浏览器访问服务地址。Docker Desktop 页面应显示所有容器状态为 Running。

注意:在 Windows 系统上,需要先安装 WSL (Windows Subsystem for Linux),以支持 Docker Desktop 的正常运行。

部署 Ollama

下载与安装

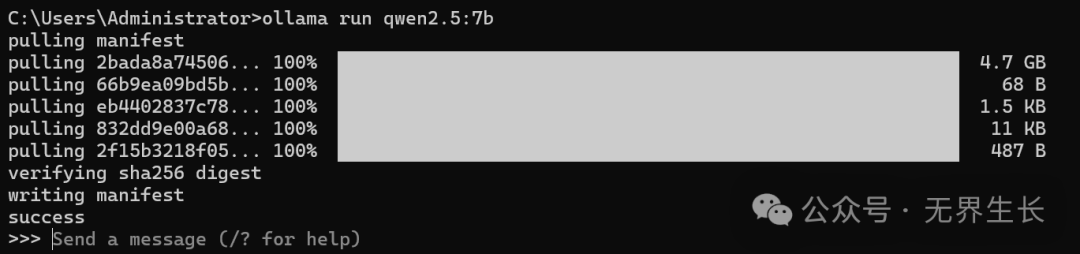

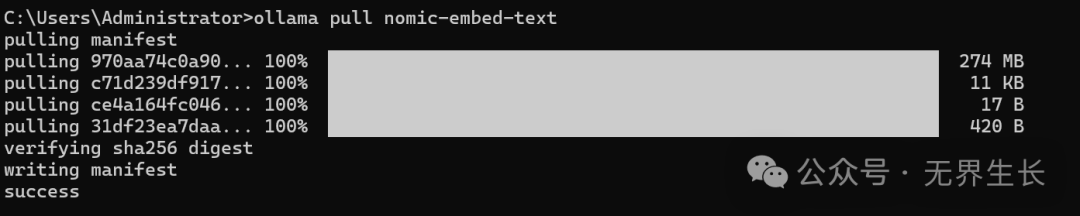

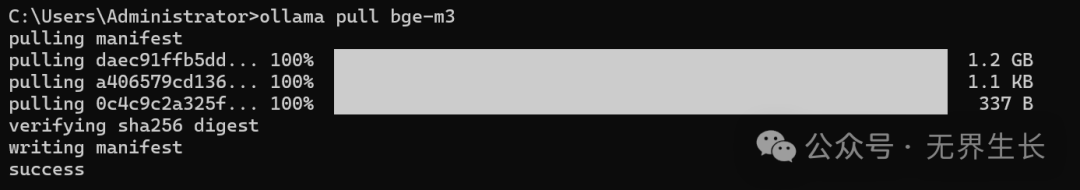

访问 Ollama 官网下载对应系统的客户端。对于 Windows 用户,请下载 Windows 版本并完成安装运行。