AI 绘画 Stable Diffusion:SDXL Controlnet Tile V2 高清图像增强指南

近日,AI 绘画领域的重要工具 Stable Diffusion 的 SDXL Controlnet Tile 模型更新到了 V2 版本。这是一款专注于现实逼真绘图的 Controlnet 插件模型,广泛适用于 SD-WebUI 扩展和 ComfyUI 工作流。本次 V2 版本的更新在模型的稳定性和控制力上得到了显著提升,特别是在高分辨率下能够更精细地增强图像细节。

一、核心功能与改进点

1. 训练数据与稳定性增强

Tile V2 通过大幅改进的训练数据集和更广泛的训练步骤,显著增强了模型的泛化能力。这意味着在处理不同光照、角度和复杂背景时,模型能提供更稳定的输出结果。

2. 自动识别范围扩大

V2 版本无需明确的提示词(Prompt),也能自动识别更广泛的对象。这降低了用户的使用门槛,使得在不熟悉具体物体名称的情况下,依然能有效控制局部细节。

3. 色彩偏移问题改善

针对旧版本中常见的色彩偏移问题,V2 进行了显著优化。对于未自动识别的对象,只需添加简单的提示或使用色彩修复节点即可有效修复,确保生成图像的色彩还原度。

4. 控制强度更加稳健

在绘图控制力的某些特定场景下,Tile 模型甚至可以替代传统的 Canny + OpenPose 组合插件。其边缘保持能力和结构一致性表现更为出色。

二、应用场景

SDXL Controlnet Tile 主要应用于以下场景:

- 图像放大过程增强:在图像放大过程中增强图片细节质量,避免传统放大导致的模糊。

- 高细节图像修复:配合合适的工作流程节点,实现高细节、高分辨率的图像修复。

- 风格迁移:改变图片的风格,例如将写实照片转换为 3D 动漫风格或保留人物特征的同时更换服装。

三、使用注意事项

在使用该模型前,请务必注意以下关键点:

- 非放大模型:Tile 模型不是单纯的放大模型!它是增强或改变原始图像细节质量的模型。它不会显著改变基础模型的风格,而是向放大的像素块添加特性。

- 适用类型:这是一个基于真实图像训练集训练的模型,因此不保证适用于漫画、动画应用。若处理二次元图片,效果可能不佳。

- 参数建议:

- 去噪强度 (Denoising):对于 Tile 放大,将去噪设置在 0.3-0.4 左右可以获得更好的效果质量。

- Controlnet 强度:建议设置为 0.9 获取更好的效果质量。

- 面部一致性:对于人物图像修复,IPA (IPAdapter) 和在 Controlnet 上提前停止将提供更好的结果。

- 基础模型选择:选择一个好的现实基础模型非常重要,建议使用 RealVisXL 等写实类大模型。

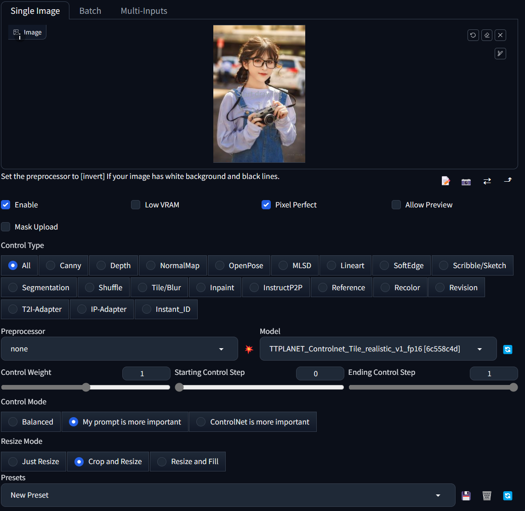

四、SD-WebUI 使用指南

SDXL Controlnet Tile 插件支持 SD-WebUI 使用。配置时需遵循以下规范:

- 预处理器设置:同时确保 100% 预处理器为 None(不要重新采样!!!)。

- 控制模式:选择 "My prompt is more important"。

- 脚本调用:在 Webui 中使用常规 Controlnet 模型,选择作为 Tile 模型,并使用

tile_resample进行 Ultimate Upscale 脚本。 - 参数配置:参考官方文档调整 Denoising Strength 至 0.3-0.4 区间。

五、ComfyUI 使用指南

在 ComfyUI 中体验 的步骤如下: