将 AI 大模型集成至致远 OA 系统实践指南

1. 背景与概述

随着人工智能技术的快速发展,将大语言模型(LLM)集成到企业级办公自动化(OA)系统中已成为提升工作效率的重要趋势。本文档详细介绍如何利用本地部署的大模型工具 Ollama、向量数据库 ChromaDB 以及 Java 开发框架 LangChain4J,实现致远 OA 系统的文档智能解析与问答功能。

核心思路是利用 OA 系统在附件上传和下载时提供的拦截机制,对文件进行预处理。具体流程包括:

- 文件拦截:监听附件上传事件。

- 内容解析:将文档转换为文本格式。

- 向量化处理:利用 Embedding 模型将文本转化为向量。

- 向量存储:存入 ChromaDB 向量数据库。

- 检索增强生成:根据用户提问检索相关片段,结合 LLM 生成回答。

此外,该架构还支持杀毒扫描、加密解密、舆情监控及审计日志等安全合规功能。

2. 核心技术概念

2.1 Ollama

Ollama 是一个专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计的工具。它简化了模型的管理和推理过程,支持多种主流开源模型,如 Llama3、Qwen 等。

2.2 Embedding(嵌入)

Embedding 在机器学习和自然语言处理中,是将词汇、句子、段落甚至整个文档转换为实数向量的过程。这种转换允许模型理解语义相似性,例如词义相近的单词在嵌入空间中的向量距离会更近。

2.3 大语言模型 (LLM)

LLM(Large Language Model)是指使用大量文本数据训练的深度学习模型。其核心思想是通过大规模无监督训练学习自然语言的模式和结构。LLM 可用于文本生成、问答系统、语义理解和推理等任务。

2.4 ChromaDB 向量数据库

ChromaDB 是一个轻量级向量数据库,主要用于存储和查询大规模高维数据。它特别适用于 NLP 和机器学习应用,能够提供高效的向量检索和语义搜索功能,是构建 RAG(检索增强生成)系统的关键组件。

3. 环境搭建

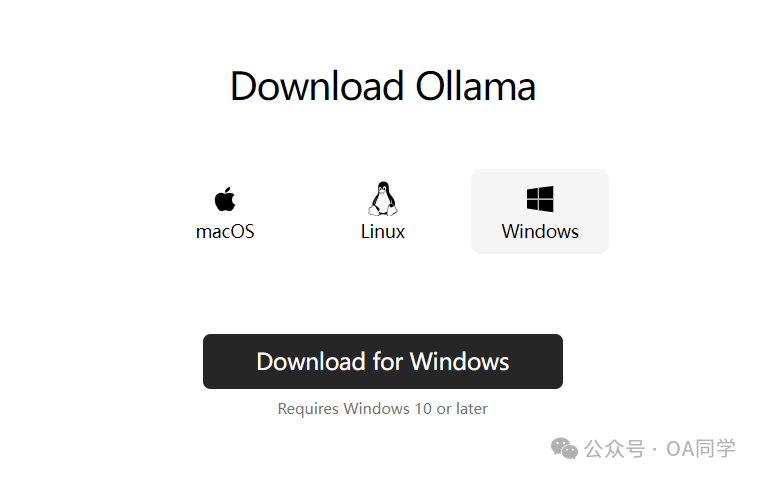

3.1 安装 Ollama

访问 Ollama 官网下载安装包并安装。安装后启动服务,默认端口为 11434。浏览器访问 http://localhost:11434 确认服务运行状态。

3.2 拉取大模型

通过命令行下载所需的模型。命令格式为 ollama pull modelName。

- 英文场景:推荐使用

llama3。 - 中文场景:推荐使用

qwen(通义千问)。 - 开发建议:若电脑内存较小(如 8GB),建议使用小参数模型(如 3B 版本);开发环境建议至少 16GB 内存。

本次教程以 qwen2.5:3b 为例,适合开发测试。

查看已下载模型列表:

ollama list

3.3 启动大模型

使用命令行启动模型并进行对话测试:

ollama run qwen2.5:3b

启动后可直接输入指令与大模型交互,例如询问 "介绍一下 LangChain"。

3.4 安装 ChromaDB

- Python 环境:确保已安装 Python,推荐版本为 3.11.10 左右。

- 安装库:执行

pip install chromadb。 - 启动服务:执行 ,默认监听端口通常为 8000。