Python 采集电视剧《开端》弹幕并生成词云图

引言

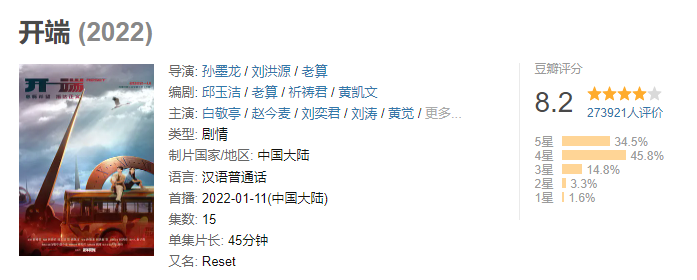

网络视频平台的弹幕功能为用户提供了实时互动的体验,其中蕴含了大量用户的情感倾向和观点。通过爬虫技术采集弹幕数据,并进行文本挖掘与可视化分析,可以帮助我们了解观众对剧集的关注点、情感分布以及剧情讨论的热度。本文将以国产剧《开端》为例,演示如何使用 Python 采集其弹幕数据,经过清洗处理后,利用词云图进行可视化展示。

一、环境准备

在开始之前,请确保您的开发环境已安装以下工具和库:

- Python 版本:建议 Python 3.8 及以上版本。

- IDE:推荐使用 PyCharm 或 VS Code。

- 依赖库:

requests:用于发送 HTTP 请求。pandas:用于数据处理和分析。jieba:用于中文分词(需自行安装)。pyecharts:用于生成交互式词云图。

安装命令如下:

pip install requests pandas jieba pyecharts

二、网站分析与接口定位

1. 寻找弹幕接口

打开目标视频网站的网页版,播放《开端》剧集,观察屏幕上的弹幕。使用浏览器开发者工具(F12),切换到 Network(网络)面板,选择 XHR 或 Fetch 过滤器。

在页面上搜索特定的弹幕内容(例如输入'那么多座位你俩非要挤一起吗'),可以在请求列表中找到对应的 JSON 数据包。该数据包通常包含一个 comments 字段,里面存储了具体的弹幕信息。

2. 参数分析

通过分析请求 URL,可以发现弹幕接口的结构通常由以下部分组成:

- 基础地址:如

https://mfm.video.qq.com/danmu - 类型参数:

otype=json,指定返回格式为 JSON。 - 目标 ID:

target_id,对应视频的特定标识。 - 时间戳:

timestamp,用于获取不同时间段的弹幕,通常每隔 30 秒更新一次。 - 其他参数:如

vid,session_key等,根据具体网站而定。

URL 示例:

https://mfm.video.qq.com/danmu?otype=json&target_id=7626117232&vid=n0041aa087e&session_key=0,0,0×tamp={page}&_=1641804763748

注意:实际项目中需要动态构造这些参数,特别是 timestamp 需要根据循环逻辑递增,以获取全集的弹幕数据。

三、数据采集实现

1. 编写爬虫脚本

我们需要遍历每一集的时间段,发送请求并解析 JSON 数据。以下是完整的采集代码示例:

import requests

import pandas pd

time

data_set = []

page (, , ):

:

url =

headers = {

:

}

response = requests.get(url=url, headers=headers)

response.encoding =

json_data = response.json()

comments = json_data.get(, [])

comment comments:

data_dict = {}

data_dict[] = comment.get()

data_dict[] = comment.get()

data_dict[] = comment.get()

data_dict[] = comment.get()

(data_dict)

data_set.append(data_dict)

time.sleep()

Exception e:

()

df = pd.DataFrame(data_set)

df.to_csv(, index=, encoding=)

()