中国人工智能大模型技术发展白皮书深度解析

第 1 章 大模型技术概述

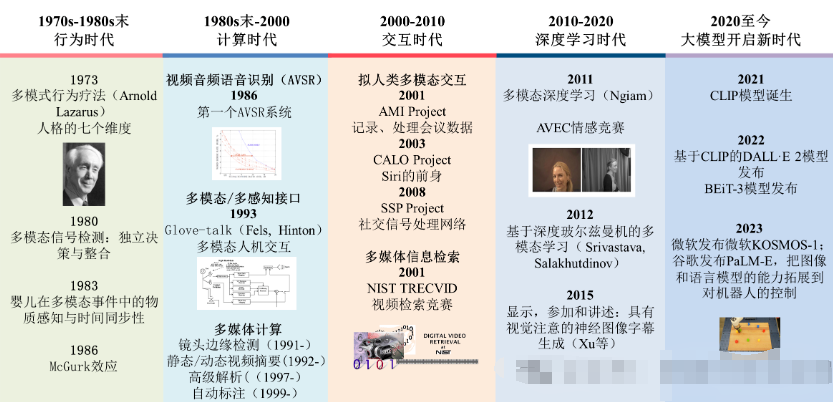

1.1 大模型技术的发展历程

自 2006 年 Geoffrey Hinton 提出通过逐层无监督预训练攻克深层网络训练难题以来,深度学习在众多领域均取得了显著的突破。其发展历程从最初的标注数据监督学习,逐渐演进到预训练模型,最终迈向大模型的新纪元。2022 年底,OpenAI 发布的 ChatGPT 凭借其卓越的性能引发了广泛的关注,充分展现了大模型在处理多场景、多用途、跨学科任务时的强大能力。因此,大模型被普遍认为是未来人工智能领域不可或缺的关键基础设施。

在这场技术热潮中,语言大模型作为领军者,通过大规模预训练学习了丰富的语言知识与世界知识,进而拥有了面向多任务的通用求解能力。其发展脉络清晰可见,历经统计语言模型、神经语言模型、预训练语言模型,直至现在的语言大模型(探索阶段)的四个阶段。

- 统计语言模型:虽然基于马尔可夫假设,但由于数据稀疏问题的影响,其能力有限,难以捕捉长距离依赖关系。

- 神经语言模型:通过神经网络对语义共现关系进行建模,成功地捕获了复杂语义依赖,显著提升了表示能力。

- 预训练语言模型:采用'预训练 + 微调'的范式,通过自监督学习使模型能够适配各种下游任务,如 BERT 等架构的出现标志着这一阶段的成熟。

- 大模型:基于缩放定律(Scaling Law)。简单来说就是,随着模型参数和预训练数据规模的不断增加,模型的能力与任务效果会持续提升,甚至展现出了一些小规模模型所不具备的独特'涌现能力'。

1.2 大模型技术的生态发展

当前,大模型技术生态正在蓬勃发展,多种服务平台向个人用户和商业应用开放。OpenAI API 让用户轻松访问不同 GPT 模型以完成任务。Anthropic 的 Claude 系列模型强调有用性、诚实性和无害性。百度文心一言基于知识增强的大模型,提供开放服务和插件机制。讯飞星火认知大模型具备开放式知识问答、多轮对话、逻辑和数学能力,以及对代码和多模态的理解能力。此外,华为联合发布了支持大模型训练私有化的'星火一体机',推动了企业级部署的落地。

1.3 大模型技术的风险与挑战

然而,大模型技术依然面临诸多风险与挑战。其可靠性尚未得到充分保障,合成内容在事实性和时效性上仍存在缺陷。大模型的可解释性相对较弱,其工作原理难以透彻理解。此外,应用大模型的部署成本高昂,涉及大量训练和推理计算,功耗高,应用成本高,且端侧推理存在延迟等问题。在大数据匮乏的情况下,大模型的迁移能力受到制约,鲁棒性和泛化性面临严峻挑战。更为严重的是,大模型还存在被滥用于生成虚假信息、恶意引导行为等衍生技术风险,以及安全与隐私问题。

第 2 章 语言大模型技术

2.1 Transformer 架构

Transformer 架构是当今大模型的核心基石。它摒弃了传统的循环神经网络(RNN)结构,完全基于注意力机制(Attention Mechanism)来处理序列数据。Self-Attention 机制允许模型在处理任意两个位置的关系时直接建立连接,无论它们之间的距离有多远,从而有效解决了长序列训练中的梯度消失问题。多头注意力机制(Multi-Head Attention)则让模型能够从不同的子空间同时关注信息,增强了表征能力。位置编码(Positional Encoding)的引入弥补了 Transformer 缺乏顺序信息的短板,使其能够理解文本的时序结构。

2.2 语言大模型架构

2.2.1 掩码语言建模 (MLM)

掩码语言建模是双向上下文建模的典型代表,如 BERT 模型。该方法随机掩盖输入序列中的一部分 token,要求模型根据左右两侧的上下文信息预测被掩盖的内容。这种训练方式极大地增强了模型对语义的理解能力,特别适用于分类、抽取等判别式任务。

2.2.2 自回归语言建模 (AR)

自回归语言建模是单向生成的基础,如 GPT 系列模型。模型按从左到右的顺序预测下一个 token,仅利用左侧的历史信息。这种方式更适合生成式任务,如文本续写、对话生成等,能够产生连贯的自然语言输出。

2.2.3 序列到序列建模 (Seq2Seq)

序列到序列建模结合了编码器和解码器结构,常用于机器翻译等任务。编码器将输入序列压缩为隐状态,解码器根据该状态生成输出序列。在大模型时代,这种架构演变为更高效的 Encoder-Decoder 混合模式,兼顾了理解与生成的优势。

2.3 语言大模型关键技术

2.3.1 语言大模型的预训练

预训练是大模型能力的来源。通过在海量无标注文本上进行自监督学习,模型学习到了语言的语法、常识及逻辑推理能力。预训练目标通常包括 Next Token Prediction 或 Masked Language Modeling。为了提升效率,研究者采用了混合精度训练、梯度累积等技术来应对显存限制。