LangChain 应用开发:TruLens 利用量化技术对抗模型幻觉

TruLens 是面向神经网络应用的质量评估工具,通过反馈函数客观评估基于 LLM 应用的质量和效果。文章介绍了在 LangChain 中集成 TruLens 的方法,包括使用 TruChain 包装对象并记录反馈数据。重点阐述了 RAG 三角形的三个评估指标:上下文相关性、有根据性和答案相关性,并通过代码示例展示了如何定义反馈函数及运行评估控制台。该技术有助于量化模型不确定性,发现并解决应用问题。

TruLens 是面向神经网络应用的质量评估工具,通过反馈函数客观评估基于 LLM 应用的质量和效果。文章介绍了在 LangChain 中集成 TruLens 的方法,包括使用 TruChain 包装对象并记录反馈数据。重点阐述了 RAG 三角形的三个评估指标:上下文相关性、有根据性和答案相关性,并通过代码示例展示了如何定义反馈函数及运行评估控制台。该技术有助于量化模型不确定性,发现并解决应用问题。

在 AI 的发展中,大规模语言模型已经取得了令人瞩目的成果,然而随之而来的是模型质量和不确定性的问题。如何衡量和改进模型的质量,一直是面临的一个挑战。

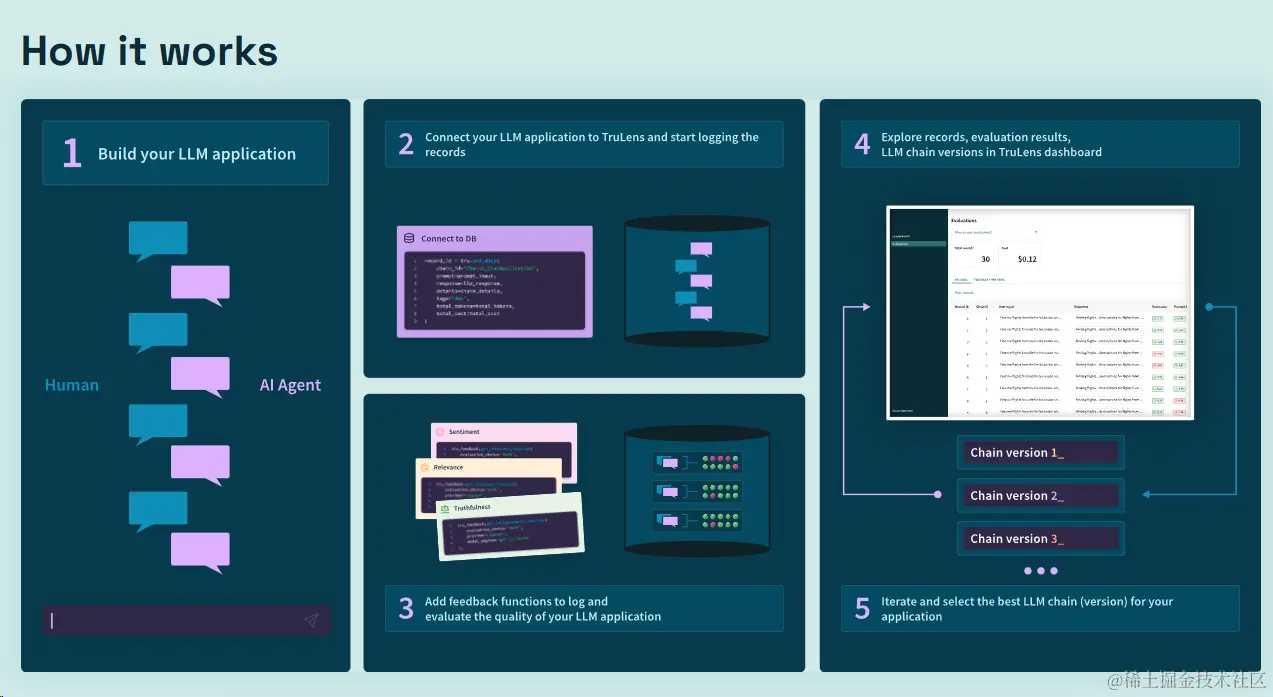

TruLens 是面向神经网络应用的质量评估工具,它可以帮助你使用反馈函数来客观地评估基于 LLM(语言模型)应用的质量和效果。反馈函数可以帮助以编程的方式评估输入、输出和中间结果的质量,从而加快和扩大实验评估的范围。你可以将它用于各种各样的用例,包括问答、检索增强生成和基于代理的应用。

TruLens 的核心思想是,你可以为你的应用定义一些反馈函数,这些函数可以根据你的应用的目标和期望,对你的应用的表现进行打分或分类。例如:

TruLens 可以让你在开发和测试你的应用的过程中,实时地收集和分析你的应用的反馈数据,从而帮助你发现和解决你的应用的问题,提高你的应用的质量和效果。你可以使用 TruLens 提供的易用的用户界面,来查看和比较你的应用的不同版本的反馈数据,从而找出你的应用的优势和劣势,以及改进的方向。

LangChain 作为一种新的语言模型框架,提供了一种有效的部署和管理大规模语言模型的框架。使用 LangChain 管理模型,不仅可以轻松部署和执行模型,还可以方便地观察模型的内部状态。再结合 TruLens 的评估工具,我们就可以对模型的质量进行深入理解和改进。

要在 LangChain 中使用 TruLens 来评估你的应用,你只需要做两件事:

下面是一个简单的示例,展示了如何在 LangChain 中使用 TruLens 来评估一个问答应用:

pip install trulens_eval

# 导入 LangChain 和 TruLens

from langchain.chains import LLMChain

from langchain.llms import OpenAI

from langchain.prompts import PromptTemplate

from langchain.prompts.chat import ChatPromptTemplate, HumanMessagePromptTemplate

from trulens_eval import TruChain, Feedback, Huggingface, Tru, OpenAI as TruOpenAI

from trulens_eval.feedback.provider.langchain import Langchain

tru = Tru()

# 定义一个问答应用的提示模板

full_prompt = HumanMessagePromptTemplate(

prompt=PromptTemplate(

template="Provide a helpful response with relevant background information for the following: {prompt}",

input_variables=["prompt"],

)

)

chat_prompt_template = ChatPromptTemplate.from_messages([full_prompt])

# 创建一个 LLMChain 对象,使用 llm 和 chat_prompt_template 作为参数

llm = OpenAI()

chain = LLMChain(llm=llm, prompt=chat_prompt_template, verbose=True)

# Initialize Huggingface-based feedback function collection class:

# Define a language match feedback function using HuggingFace.

hugs = Huggingface()

f_lang_match = Feedback(hugs.language_match).on_input_output()

# Question/answer relevance between overall question and answer.

provider = TruOpenAI()

f_qa_relevance = Feedback(provider.relevance).on_input_output()

# 使用 TruChain 类来包装 chain 对象,指定反馈函数和应用 ID

tru_recorder = TruChain(

chain,

app_id='Chain1_QAApplication',

feedbacks=[f_lang_match, f_qa_relevance])

# 使用 with 语句来运行 chain 对象,并记录反馈数据

with tru_recorder as recording:

# 输入一个问题,得到一个回答

chain("What is langchain?")

# 查看反馈数据

tru_record = recording.records[0]

# 打印反馈数据

print("tru_record:", tru_record)

# 启动 tru 展示控制台

tru.run_dashboard()

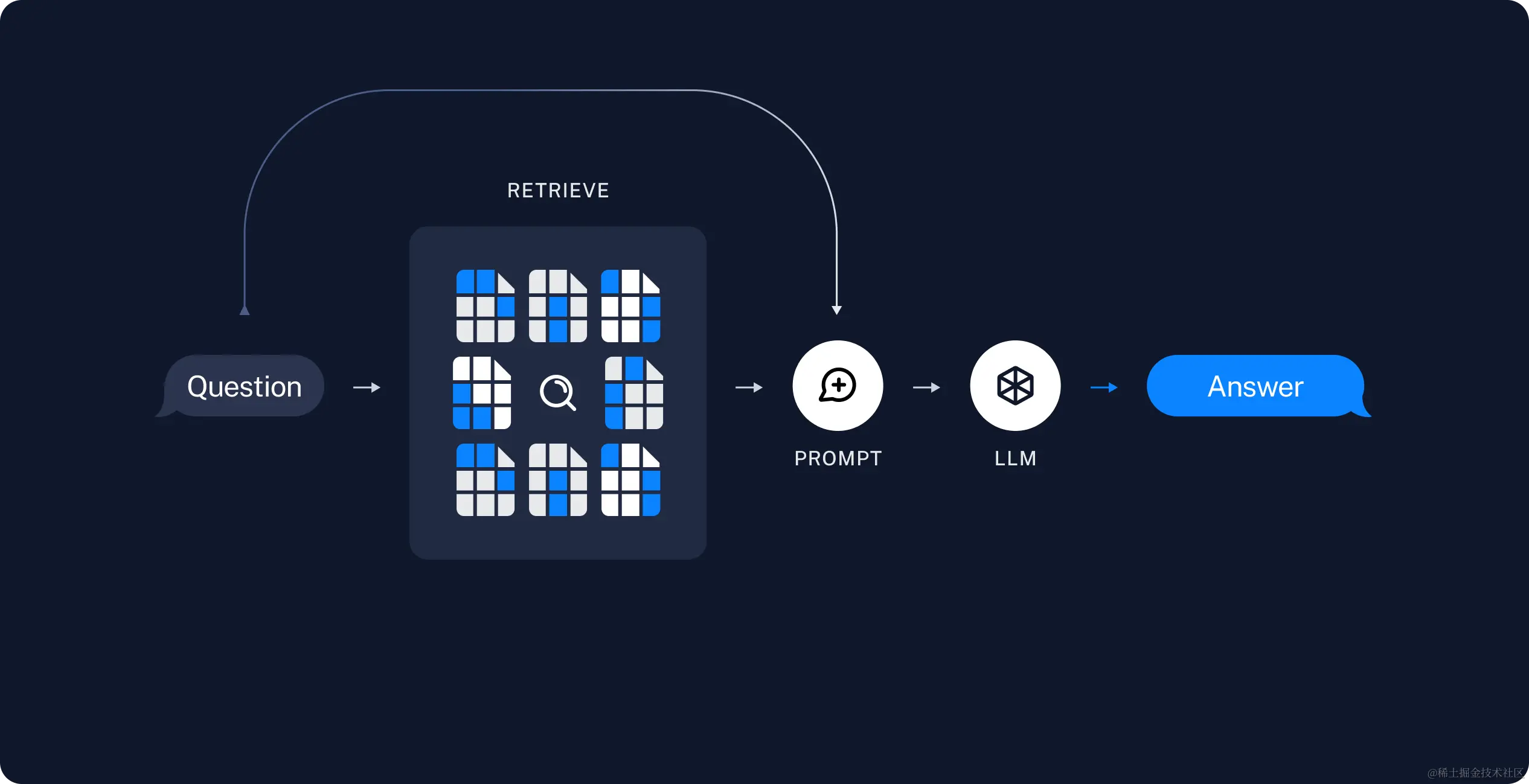

RAG(Retrieval-Augmented Generation)是一种基于 LLM 的应用,它可以利用检索系统来增强 LLM 的生成能力。RAG 的工作原理是,当给定一个输入时,它会先从一个大规模的知识库中检索出一些相关的文档,然后将这些文档作为 LLM 的上下文,再使用 LLM 来生成一个输出。RAG 可以用于各种生成任务,例如问答、摘要、对话等。

RAG 的优点是,它可以利用检索系统来提供 LLM 所缺乏的知识和信息,从而提高 LLM 的生成质量和多样性。RAG 的缺点是,它也可能引入一些错误和幻觉,例如检索出不相关或不准确的文档,或者生成与输入或文档不一致的输出。

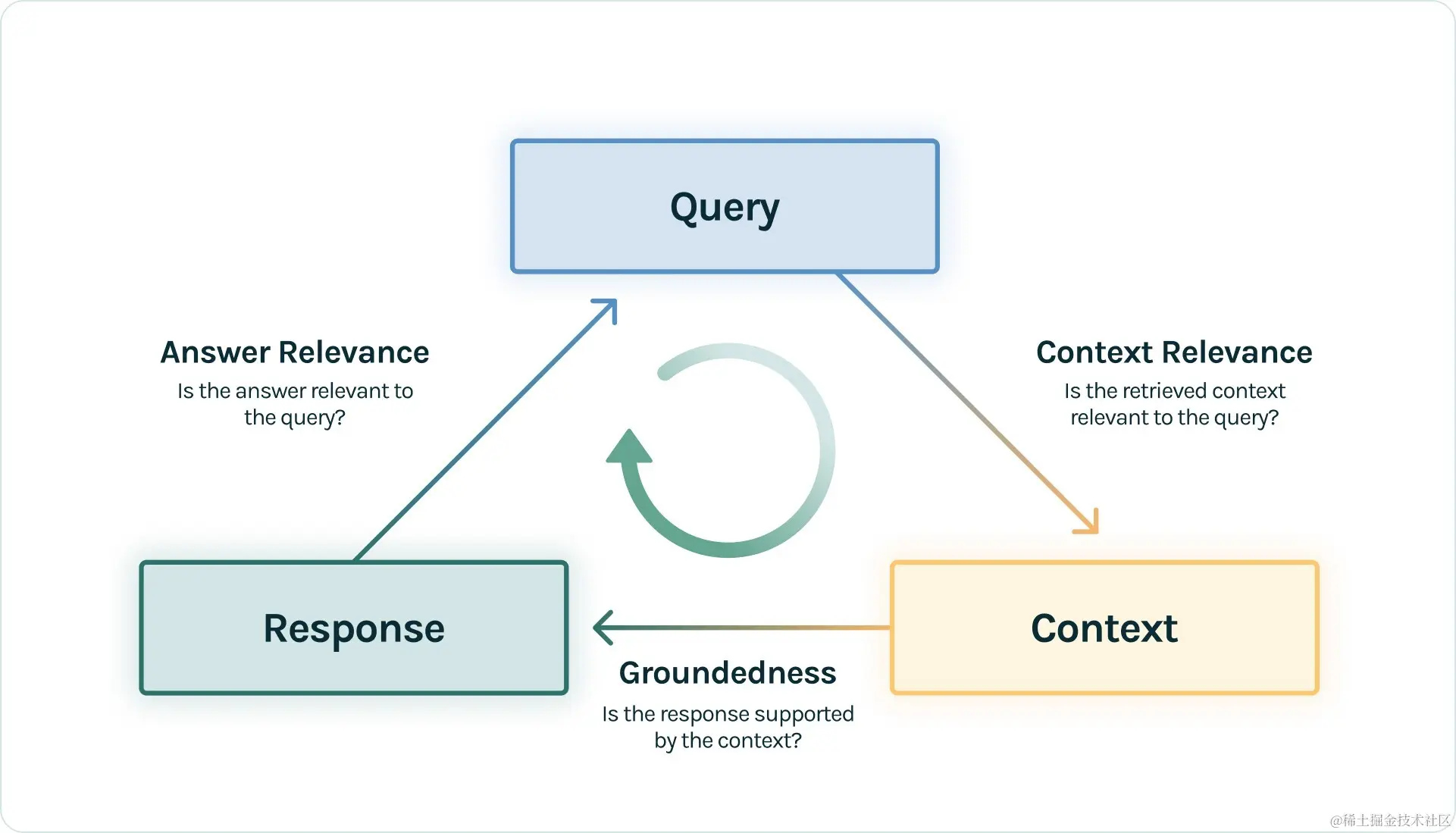

为了评估 RAG 的质量和效果,我们可以使用 TruLens 提供的 RAG 三角形(RAG Triad)的评估方法。RAG 三角形是由三个评估指标组成的,分别是:

RAG 三角形的评估方法可以让我们从不同的角度来检验 RAG 的质量和效果,从而发现和改进 RAG 的问题。我们可以使用 TruLens 来实现 RAG 三角形的评估方法,具体步骤如下:

下面是一个简单的示例,展示了如何在 LangChain 中使用 TruLens 来评估一个 RAG 问答应用:

# 导入 LangChain 和 TruLens

from IPython.display import JSON

# Imports main tools:

from trulens_eval import TruChain, Feedback, Huggingface, Tru

from trulens_eval.schema import FeedbackResult

tru = Tru()

tru.reset_database()

# Imports from langchain to build app

import bs4

from langchain import hub

from langchain.chat_models import ChatOpenAI

from langchain.document_loaders import WebBaseLoader

from langchain.embeddings import OpenAIEmbeddings

from langchain.schema import StrOutputParser

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.vectorstores import Chroma

from langchain_core.runnables import RunnablePassthrough

from trulens_eval.feedback.provider import OpenAI

import numpy as np

from trulens_eval.app import App

from trulens_eval.feedback import Groundedness

# 加载文件

loader = WebBaseLoader(

web_paths=("https://lilianweng.github.io/posts/2023-06-23-agent/",),

bs_kwargs=dict(

parse_only=bs4.SoupStrainer(

class_=("post-content", "post-title", "post-header")

)

),

)

docs = loader.load()

# 分词

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=)

splits = text_splitter.split_documents(docs)

vectorstore = Chroma.from_documents(documents=splits, embedding=OpenAIEmbeddings())

retriever = vectorstore.as_retriever()

prompt = hub.pull()

llm = ChatOpenAI(model_name=, temperature=)

():

.join(doc.page_content doc docs)

rag_chain = (

{: retriever | format_docs, : RunnablePassthrough()}

| prompt

| llm

| StrOutputParser()

)

provider = OpenAI()

context = App.select_context(rag_chain)

grounded = Groundedness(groundedness_provider=provider)

f_groundedness = (

Feedback(grounded.groundedness_measure_with_cot_reasons)

.on(context.collect())

.on_output()

.aggregate(grounded.grounded_statements_aggregator)

)

f_qa_relevance = Feedback(provider.relevance).on_input_output()

f_context_relevance = (

Feedback(provider.qs_relevance)

.on_input()

.on(context)

.aggregate(np.mean)

)

tru_recorder = TruChain(rag_chain,

app_id=,

feedbacks=[f_qa_relevance, f_context_relevance, f_groundedness])

tru_recorder recording:

llm_response = rag_chain.invoke()

rec = recording.get()

(rec)

tru.run_dashboard()

在本文中,我们介绍了如何在 LangChain 中使用 TruLens 来对 LLM 进行评估和优化,以及如何利用 TruLens 的结果来量化和对抗模型的不确定性。我们通过一个文本生成的任务为例,演示了如何使用 TruLens 来对模型的输出进行测量和量化,以及对模型的行为进行分析和解释。我们还分享了一个 RAG 案例代码,用实际指标说明了 TruLens 的评估结果。未来将有更多的工具和方法,可以对 LLM 进行更有效的评估和优化,以及更好地量化和对抗模型的不确定性,这将有助于推动 LLM 的发展和应用,以及提升 AI 语言的水平和价值。

微信公众号「极客日志」,在微信中扫描左侧二维码关注。展示文案:极客日志 zeeklog

使用加密算法(如AES、TripleDES、Rabbit或RC4)加密和解密文本明文。 在线工具,加密/解密文本在线工具,online

生成新的随机RSA私钥和公钥pem证书。 在线工具,RSA密钥对生成器在线工具,online

基于 Mermaid.js 实时预览流程图、时序图等图表,支持源码编辑与即时渲染。 在线工具,Mermaid 预览与可视化编辑在线工具,online

解析常见 curl 参数并生成 fetch、axios、PHP curl 或 Python requests 示例代码。 在线工具,curl 转代码在线工具,online

将字符串编码和解码为其 Base64 格式表示形式即可。 在线工具,Base64 字符串编码/解码在线工具,online

将字符串、文件或图像转换为其 Base64 表示形式。 在线工具,Base64 文件转换器在线工具,online