AI 问答知识库本地化部署指南:基于 FastGPT

本文详细介绍了基于 FastGPT 的 AI 问答知识库本地化部署全流程。内容包括本地部署的优势分析、技术架构选型、Docker 环境准备、M3E 向量模型与 OneAPI 的安装配置、FastGPT 核心服务的启动以及 MongoDB 副本集初始化。此外,还涵盖了知识库创建、应用搭建、API 集成方法以及常见问题的排查与安全防护建议,旨在帮助用户构建安全可控的私有化 AI 问答系统。

本文详细介绍了基于 FastGPT 的 AI 问答知识库本地化部署全流程。内容包括本地部署的优势分析、技术架构选型、Docker 环境准备、M3E 向量模型与 OneAPI 的安装配置、FastGPT 核心服务的启动以及 MongoDB 副本集初始化。此外,还涵盖了知识库创建、应用搭建、API 集成方法以及常见问题的排查与安全防护建议,旨在帮助用户构建安全可控的私有化 AI 问答系统。

在当今信息爆炸的时代,处理大量信息并快速寻找特定答案成为关键需求。AI 问答知识库是一种基于人工智能技术的系统,旨在通过理解自然语言问题并从存储的知识库中提取相关信息,以准确、快速地回答用户的问题。这种技术不仅在搜索引擎、智能助手和客户服务领域有着广泛的应用,还在医疗、金融、教育等各个领域展现了巨大的潜力。

虽然云端提供了便捷的 AI 服务,但在某些场景下,本地部署 AI 问答知识库更为合适。

本方案采用 Docker 容器化部署,主要组件包括向量数据库、大语言模型服务(LLM)、API 网关及应用前端。整体架构支持高可用扩展,便于后续维护。

本教程采用 FastGPT 来实现本地知识库构建。

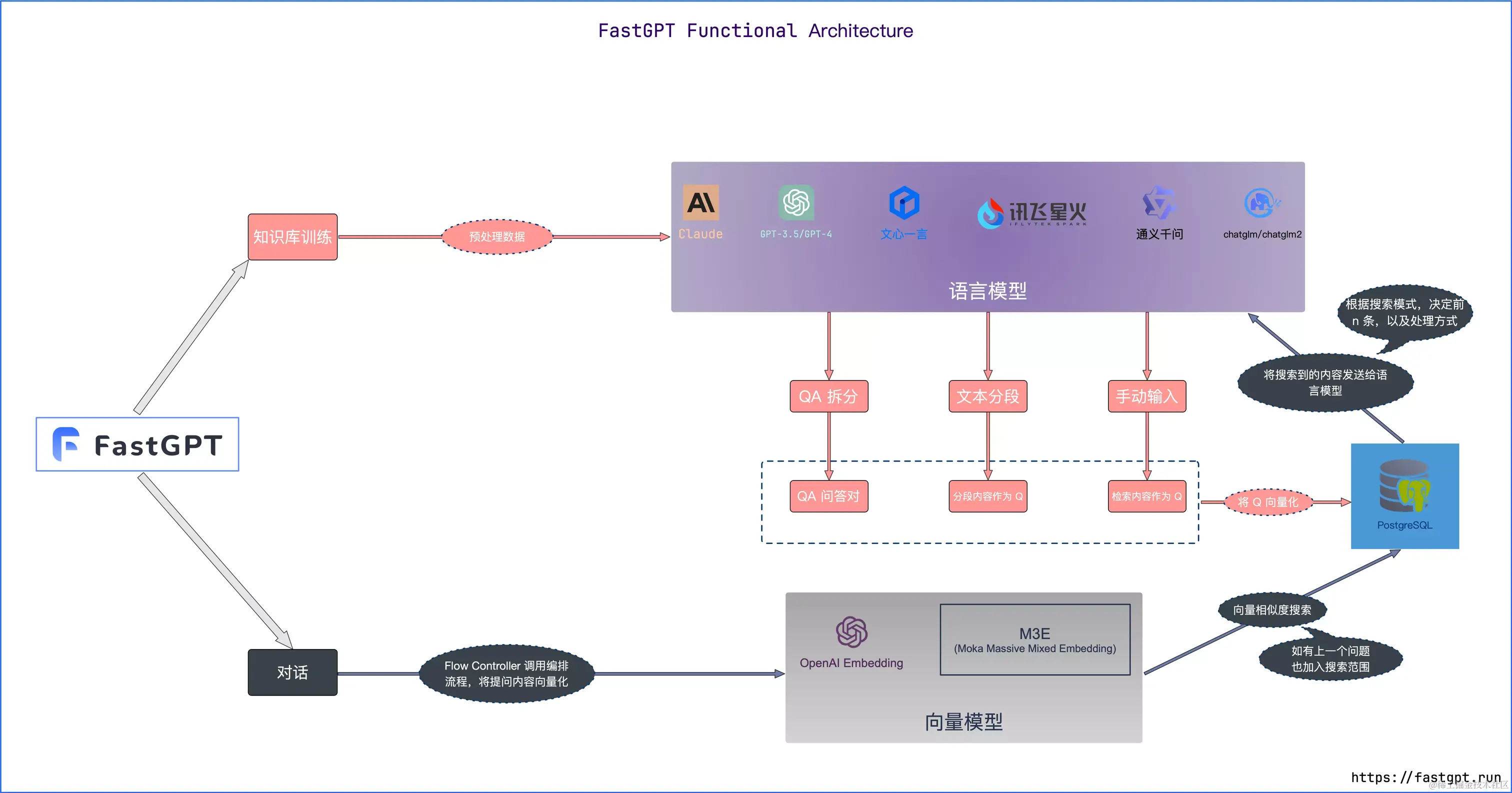

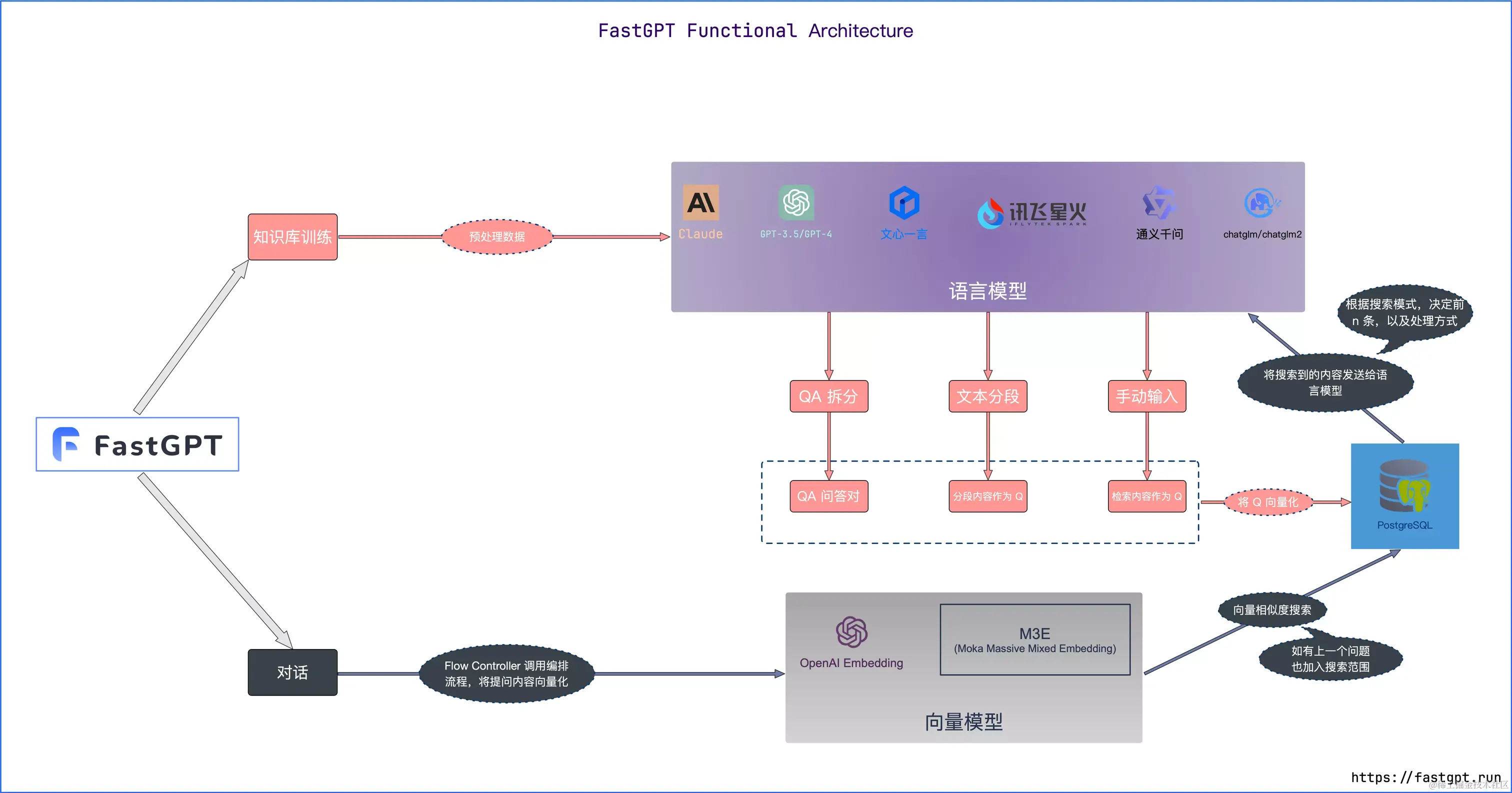

FastGPT 是一个基于 LLM 大语言模型的知识库问答系统,提供开箱即用的数据处理、模型调用等能力。同时可以通过 Flow 可视化进行工作流编排,从而实现复杂的问答场景。

通过导入文档或已有问答对进行训练,让 AI 模型能根据你的文档以交互式对话方式回答问题。

FastGPT 采用直观的可视化界面设计,为各种应用场景提供了丰富实用的功能。通过简洁易懂的操作步骤,可以轻松完成 AI 客服的创建和训练流程。

提供手动输入、直接分段、LLM 自动处理和 CSV 等多种数据导入途径。其中'直接分段'支持通过 PDF、WORD、Markdown 和 CSV 文档内容作为上下文。FastGPT 会自动对文本数据进行预处理、向量化和 QA 分割,节省手动训练时间,提升效能。

基于 Flow 模块的工作流编排,可以帮助你设计更加复杂的问答流程。例如查询数据库、查询库存、预约实验室等。

FastGPT 对外的 API 接口对齐了 OpenAI 官方接口,可以直接接入现有的 GPT 应用,也可以轻松集成到企业微信、公众号、飞书等平台。

建议最低配置如下:

服务器需要安装好 Docker 环境。

(此处省略架构图,实际部署请参考官方文档获取最新拓扑图)

# 安装 Docker

curl -fsSL https://get.docker.com | bash -s docker --mirror Aliyun

systemctl enable --now docker

# 安装 docker-compose

curl -L https://github.com/docker/compose/releases/download/v2.20.3/docker-compose-$(uname -s)-$(uname -m) -o /usr/local/bin/docker-compose

chmod +x /usr/local/bin/docker-compose

# 验证安装

docker -v

docker-compose -v

给 docker 中的容器创建一个共用网络,确保各组件间通信。

docker network create my-network

用于处理文本向量化,支持中文语义理解。

docker run -d --name m3e --network my-network -p 3030:6008 registry.cn-hangzhou.aliyuncs.com/fastgpt_docker/m3e-large-api

OneAPI 用于统一管理不同的大模型 API 密钥和路由。

docker run --name one-api --network my-network -d --restart always -p 3200:3000 -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api

添加阿里通义千问模型和 M3E 模型。

http://localhost:3030/v1/embeddings。mkdir fastgpt

cd fastgpt

curl -O https://raw.githubusercontent.com/labring/FastGPT/main/files/deploy/fastgpt/docker-compose.yml

curl -O https://raw.githubusercontent.com/labring/FastGPT/main/projects/app/data/config.json

编辑 docker-compose.yml,修改以下环境变量:

OPENAI_BASE_URL:API 接口的地址,格式为 http://<one-api-ip>:3200/v1。CHAT_API_KEY:API 接口的凭证,对应 OneAPI 中生成的 Key。编辑 config.json,填入具体的模型 ID 和向量模型配置,确保与 OneAPI 和 M3E 服务匹配。

在 docker-compose.yml 同级目录下执行:

cd 项目目录

docker-compose pull

docker-compose up -d

MongoDB 版本 4.6.8 以前可忽略此步骤,新版本建议初始化副本集以保证数据一致性。

# 查看 mongo 容器是否正常运行

docker ps

# 进入容器

docker exec -it mongo bash

# 连接数据库(替换实际用户名和密码)

mongo -u myusername -p mypassword --authenticationDatabase admin

# 初始化副本集

rs.initiate({

_id: "rs0",

members: [

{ _id: 0, host: "mongo:27017" }

]

})

# 检查状态

rs.status()

部署完成后,访问 http://<服务器 IP>:3001/。

登录后台后,进入知识库管理页面,上传文档或输入文本。系统会自动进行切片和向量化处理。

选择已导入的知识库,创建新的对话应用。可配置开场白、回复风格等参数。

在应用详情页进行测试,验证问答效果。根据反馈调整知识库内容或提示词。

FastGPT 支持接入到其他系统中。通过提供的 API 接口,可以将 AI 能力嵌入到企业内部系统、网站或移动端应用中。

检查日志 docker-compose logs,确认端口冲突或镜像拉取失败。确保 Docker 版本兼容。

检查 OneAPI 配置是否正确,确保 OPENAI_BASE_URL 包含 /v1 后缀。验证 API Key 权限。

如果数据量大,考虑增加 M3E 模型的显存或优化切片策略。检查 MongoDB 索引情况。

通过上述步骤,您可以成功在本地部署一套完整的 AI 问答知识库系统。FastGPT 提供了灵活的配置和强大的扩展能力,适合各类企业级应用场景。定期更新组件和关注官方社区动态,有助于保持系统的稳定性和安全性。

微信公众号「极客日志」,在微信中扫描左侧二维码关注。展示文案:极客日志 zeeklog

生成新的随机RSA私钥和公钥pem证书。 在线工具,RSA密钥对生成器在线工具,online

基于 Mermaid.js 实时预览流程图、时序图等图表,支持源码编辑与即时渲染。 在线工具,Mermaid 预览与可视化编辑在线工具,online

将字符串编码和解码为其 Base64 格式表示形式即可。 在线工具,Base64 字符串编码/解码在线工具,online

将字符串、文件或图像转换为其 Base64 表示形式。 在线工具,Base64 文件转换器在线工具,online

将 Markdown(GFM)转为 HTML 片段,浏览器内 marked 解析;与 HTML转Markdown 互为补充。 在线工具,Markdown转HTML在线工具,online

将 HTML 片段转为 GitHub Flavored Markdown,支持标题、列表、链接、代码块与表格等;浏览器内处理,可链接预填。 在线工具,HTML转Markdown在线工具,online