大模型技术系统化学习路径指南

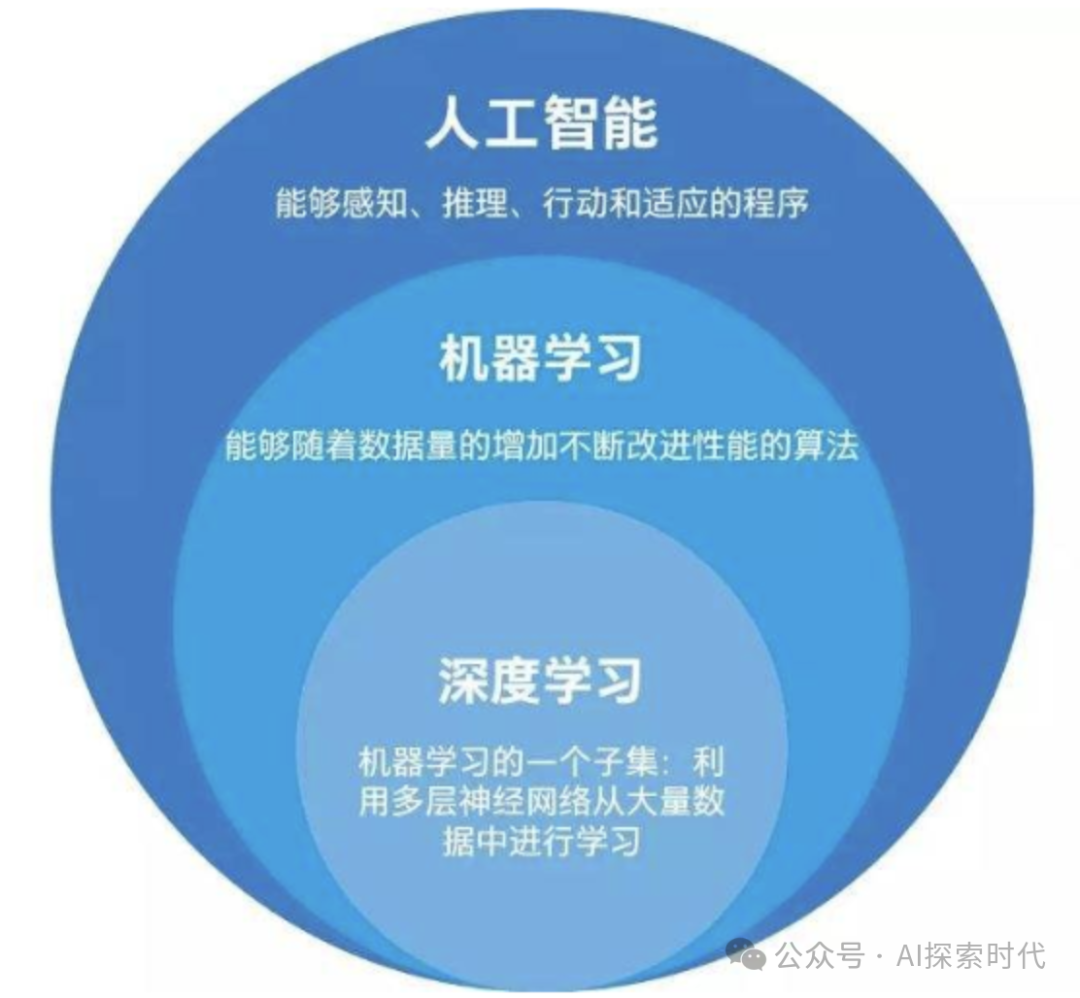

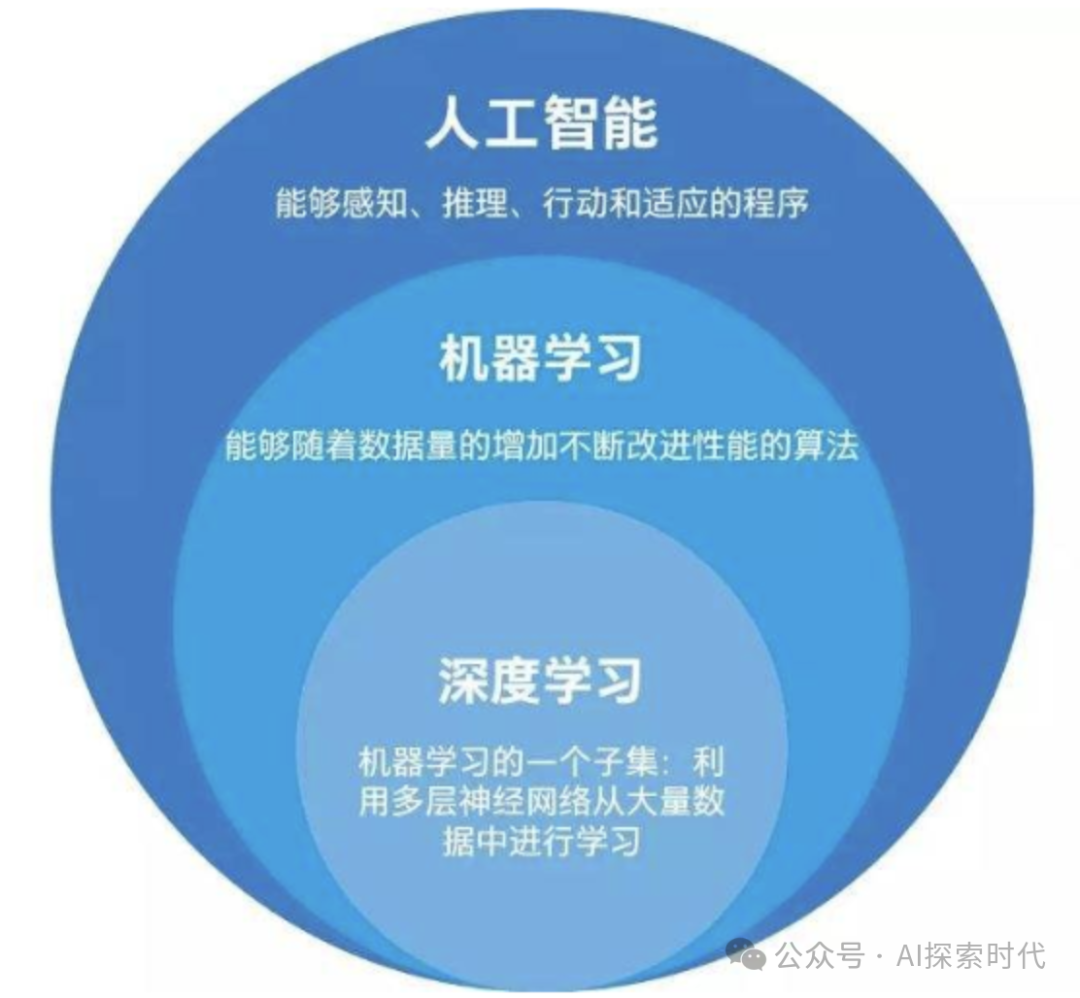

梳理了大模型技术的系统化学习路径,涵盖理论基础(数学、机器学习、自然语言处理)、实践技能(编程语言、深度学习框架、模型实现)、应用场景及持续学习方法。强调理论、实践与应用三者结合,通过预训练、微调、分布式训练等关键技术点,帮助学习者构建从入门到进阶的知识体系,掌握生成式模型、多模态技术及行业落地能力。内容包含从系统设计、提示词工程到垂直领域微调的七个进阶阶段,旨在提供完整的自学指南。

梳理了大模型技术的系统化学习路径,涵盖理论基础(数学、机器学习、自然语言处理)、实践技能(编程语言、深度学习框架、模型实现)、应用场景及持续学习方法。强调理论、实践与应用三者结合,通过预训练、微调、分布式训练等关键技术点,帮助学习者构建从入门到进阶的知识体系,掌握生成式模型、多模态技术及行业落地能力。内容包含从系统设计、提示词工程到垂直领域微调的七个进阶阶段,旨在提供完整的自学指南。

AlphaGBM 是一个集成几何布朗运动模拟与机器学习预测的期权分析平台。它支持多因子定价、AI 波动率预测及高性能计算,相比传统工具在机器学习支持和可视化方面更具优势。文章介绍了其核心架构、Python 实现细节及蒙特卡洛模拟代码示例,适用于量化风控和策略研究场景。

针对学术写作中查重与 AIGC 检测的双重压力,本文分析了传统降重方式的局限性及当前面临的合规挑战。介绍了智能降重、降 AIGC 及双重优化三种服务模式的技术特点与适用场景,梳理了从选择服务类型、上传报告到获取结果的完整操作流程。通过实际案例展示了工具在降低重复率和 AIGC 疑似度方面的效果,并强调了合规使用的重要性,倡导将工具作为辅助手段而非替代原创思考,以确保学术成果的独立性与真实性。

ChatGLM3-6B 是清华智谱开源的预训练语言模型,基于 GLM 架构结合双向编码与自回归解码优势。文章详细分析了其核心组件如 SwiGLU、RoPE 及 RMSNorm,重点阐述了 P-tuning v2 和 LoRA 两种参数高效微调机制的原理与实现差异。此外,介绍了模型量化技术如何通过 C/C++ 内核与 Base64 编码实现动态 INT4/INT8 加载以降低显存占用。提供了环境搭建、量化加载及 LoRA 配置的代码示例,…

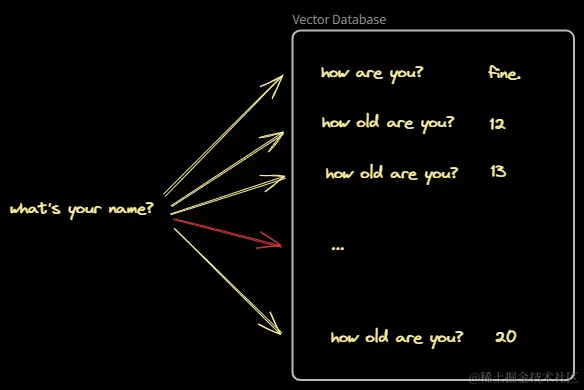

2024 年国产大模型数量超 300 个,国务院提出'人工智能 +'行动加速产业落地。基于《2024 大模型典型示范应用案例集》,分析了 97 个精选案例的特征。报告显示上海占比超 50%,大中型企业占 80%,覆盖医疗、金融、工业等 10 余个行业。关键技术趋势包括 AI Agent 占比超 23% 成为新热点,以及基于 RAG 技术的知识库成为提升落地实效的主要手段。文章探讨了区域集聚、企业规模、场景多元化及技术挑战,展望了多模态、…

位运算技巧在三道经典算法题中的具体应用。通过异或和按位与模拟加法器实现无进位求和;统计二进制位出现次数模三还原唯一数字;结合异或分组思想定位缺失的两个数值。核心在于理解位操作对数据底层的直接控制能力,避免使用常规算术运算符,从而在特定场景下优化时间与空间复杂度。

本文整理了 66 个机器人领域开源项目,覆盖科研、人形、移动、教育、医疗及工业场景。包含 MBot、ROS2、Unitree H1 等知名平台,提供仿真工具、数据集及硬件方案链接。适合开发者快速查找资源,验证算法或进行二次开发。

AAMAS 会议与期刊同属智能体及多智能体系统领域,由 IFAAMAS 主办。两者主题一致,会议论文常扩展至期刊发表。CCF 评级中,AAMAS 会议与《Autonomous Agents and Multi-Agent Systems》期刊均被评定为 B 级,是该领域重要的学术交流平台与成果存档渠道。

基于大语言模型(LLM)的本地知识库问答系统的离线部署方案。文章涵盖了大语言模型基础、Prompt 工程、RLHF 技术及 RAG 架构原理。通过 LangChain 和 ChromaDB 实现了文档加载、切片、向量化存储及检索功能,并结合 Llama2 模型完成了问答生成。内容包含完整的 Python 代码示例、环境配置指南及常见问题排查方法,旨在帮助开发者快速搭建安全、私有的智能问答系统,无需联网即可处理敏感数据。

二分查找在旋转数组找最小值和有序数组找缺失数字中的应用。针对旋转排序数组,利用区间二段性,比较中点与右端点值,收缩查找范围至单个元素。针对缺失数字问题,根据元素值与下标关系二分,定位首个不匹配位置。两种场景均将时间复杂度优化至 O(logN),避免线性遍历。

介绍 Python AI 大模型部署方案,涵盖本地运行、API 服务化及 Docker 容器封装。本地运行推荐使用 transformers 或 llama.cpp;API 服务化采用 vLLM 或 FastAPI 提供高并发接口;Docker 封装通过多阶段构建实现标准化交付。内容包含环境准备、代码示例、性能调优参数及生产部署检查清单,帮助开发者快速落地大模型应用。

梳理了人工智能大模型的核心技术脉络,涵盖基础理论、模型压缩量化、剪枝优化、扩散模型原理及 RLHF 强化学习微调方法。内容包含医疗、对话系统等垂直领域应用场景,并介绍了 LangChain、LoRA 等开发框架。旨在帮助开发者理解大模型架构,掌握高效微调与部署技能,应对行业需求变化。

单链表操作涉及删除指定值、整体反转及定位中间节点三大核心场景。删除操作可通过尾插法构建新链表实现;反转链表利用三指针迭代调整 next 指向;查找中间节点则依赖快慢指针技巧。掌握这些基础逻辑有助于提升指针运用能力,为后续数据结构学习打下坚实基础。

总结了使用 Llama-Factory 进行大模型微调时的十个常见问题及解决方案,涵盖显存溢出、LoRA 配置、Tokenizer 缺失、Loss 不下降、WebUI 端口冲突、数据格式错误、DeepSpeed 启动、QLoRA 依赖、Checkpoint 恢复及模型导出等场景。通过调整参数、检查配置文件、验证数据质量及理解底层机制,帮助开发者避免训练崩溃和无效结果,实现高效稳定的模型微调。

阐述了人形机器人四肢结构设计原则,重点包括手臂肩肘腕的解耦设计、腿部髋膝踝的驱动形式以及轻量化与力传递路线优化。通过独立自由度控制、精密传动配置及材料优化,实现运动灵活性、承载可靠性与轻量化的平衡,确保机器人在复杂场景下的稳定运行与高效作业。

对比了 Claude Code、OpenClaw、OpenCode 与 SkillLite 四种 AI 编码 Agent 的架构差异。重点分析了任务规划、记忆管理、自进化能力及安全性。SkillLite 采用 Rust 单二进制文件,具备引擎级自进化与全链路沙箱安全,弥补了竞品在开源性、本地化及安全约束上的不足。

解析了 CCF-GESP 2025 年 9 月 C++ 三级认证考试的真题,涵盖单选题、判断题及编程题。内容涉及基本数据类型、运算符、数组、函数、循环控制、变量作用域及模拟算法等知识点。提供了每道题的正确答案、详细解析及参考代码,帮助考生理解考点与解题思路。

介绍使用 LLaMA-Factory 框架对 Qwen3.5-4B 模型进行 LoRA 微调,构建医疗领域 AI 助手的完整流程。涵盖硬件要求、环境搭建、数据集准备、训练配置、效果测试及模型部署等关键步骤,并提供显存优化方案与常见问题排查指南。

2024 年中文大模型技术综述。涵盖模型定义、核心能力如文本生成与语义理解。详解提示词工程、LangChain 框架应用、知识库构建及微调策略。分析电商、物流、医疗等行业落地场景。提供从入门到部署的全栈开发路径,助力开发者掌握 GPU 算力与垂直领域训练技能,应对大数据时代需求。

人工智能应用工程师(高级)课程体系涵盖环境搭建、数据处理、核心算法、实战应用及效果测试全流程。内容涉及 Python 环境配置、深度学习框架实操、计算机视觉与自然语言处理等关键技术,强调理论结合实战,通过行业场景案例提升模型落地能力,适合希望系统掌握 AI 开发技能并获取职业认证的开发者参考。